熱門話題

#

Bonk 生態迷因幣展現強韌勢頭

#

有消息稱 Pump.fun 計劃 40 億估值發幣,引發市場猜測

#

Solana 新代幣發射平臺 Boop.Fun 風頭正勁

這是本週的儀式研究摘要,一份涵蓋LLM世界和加密與AI交集最新動態的通訊。

每週有數百篇論文發表,跟上最新動態幾乎是不可能的。我們為您閱讀,所以您無需這樣做。

RLVE:為語言模型擴展強化學習的自適應可驗證環境

作者介紹了 RLVE 用於後訓練,使用 "自適應可驗證環境" 根據模型的技能水平生成問題。

RLVE 方法通過使用 RLVE-Gym 訓練 OpenThinker3-1.5B 進行測試,該方法包含 400 種不同的學習環境。使用 RLVE 進行訓練使推理能力提高了 3.37%,同時計算資源使用量減少了 3 倍。

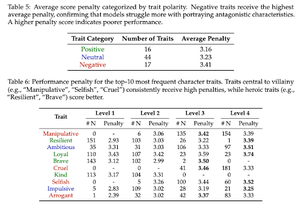

太好以至於不好:關於大型語言模型在角色扮演反派方面的失敗

這項研究發現,訓練成為有幫助和安全的 AI 模型,諷刺地說,"太好"以至於無法扮演反派。大型語言模型的表現下降,難以處理像是欺騙/操控等特徵。

安全對齊使得 AI 模型拒絕有害請求,但也阻止了它們真實地模擬道德複雜的角色,這些角色在創意寫作、遊戲和社會科學等任務中是必需的。

他們還引入了一個 "道德角色扮演" 基準來測試 LLMs。

SSR:蘇格拉底自我精煉,用於大型語言模型推理

這項工作介紹了SSR,幫助AI模型通過將答案分解為更小的部分來評估推理,識別哪些具體步驟不穩定,並修正它們。

SSR 將模型的回應分解為更小的 "蘇格拉底步驟",這些步驟類似於子問題/子答案對。這使得能夠修正推理鏈中的特定錯誤。

在 5 個基準和 3 個 LLM 中,這種有針對性的方法的表現超過了盲目自我修正的方法。

SWE-fficiency:語言模型能否在實際工作負載上優化現實世界的代碼庫?

本研究介紹了一個基準,以測試語言模型在現實世界軟體專案中優化代碼的能力。它包含來自流行機器學習庫的498個任務。

給定的回購模型必須找到性能瓶頸並修復它們。

他們發現,當今最好的 AI 模型的速度提升不到 15%。這些模型在定位需要優化的正確代碼、推理函數如何協同工作以及保持編輯無錯誤方面都面臨挑戰。

關注我們 @ritualdigest 獲取有關加密貨幣與 AI 研究的更多資訊,並且

@ritualnet 了解 Ritual 正在構建的內容。

787

熱門

排行

收藏