Topik trending

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Berikut adalah Ritual Research Digest minggu ini, buletin yang mencakup yang terbaru di dunia LLM dan persimpangan Crypto x AI.

Dengan ratusan makalah yang diterbitkan setiap minggu, tidak mungkin mengikuti perkembangan terbaru. Kami melakukan pembacaan sehingga Anda tidak perlu melakukannya.

RLVE: Meningkatkan Pembelajaran Penguatan untuk Model Bahasa dengan Lingkungan yang Dapat Diverifikasi Adaptif

Penulis memperkenalkan RLVE untuk pasca pelatihan di mana mereka menggunakan "lingkungan yang dapat diverifikasi adaptif" yang menghasilkan masalah sesuai dengan tingkat keahlian model.

Metode RLVE diuji dengan melatih OpenThinker3-1.5B menggunakan RLVE-Gym, kumpulan 400 lingkungan belajar yang berbeda. Pelatihan dengan RLVE menghasilkan peningkatan 3,37% dalam keterampilan penalaran sambil menggunakan komputasi 3x lebih sedikit.

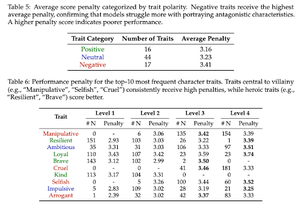

Terlalu Bagus untuk Menjadi Buruk: Tentang Kegagalan LLM untuk Memainkan Penjahat Peran

Karya ini menemukan bahwa model AI yang dilatih untuk membantu & aman ironisnya "terlalu bagus" untuk memainkan peran penjahat. LLM menurun dalam kinerja, berjuang dengan sifat-sifat seperti penipuan/manipulatif.

Penyelarasan keamanan yang membuat model AI menolak permintaan berbahaya juga mencegah mereka mensimulasikan karakter yang kompleks secara moral secara otentik yang diperlukan untuk tugas-tugas seperti penulisan kreatif, game, dan ilmu sosial.

Mereka juga memperkenalkan tolok ukur "Moral RolePlay" untuk menguji LLM.

SSR: Penyempurnaan Diri Socrates untuk Penalaran Model Bahasa Besar

Pekerjaan ini memperkenalkan SSR, yang membantu model AI menilai penalaran dengan memecah jawaban menjadi potongan-potongan yang lebih kecil, mengidentifikasi langkah spesifik mana yang goyah, dan memperbaikinya.

SSR memecah respons model menjadi "langkah-langkah Socrates" yang lebih kecil, yang seperti pasangan sub-pertanyaan/sub-jawaban. Ini memungkinkan untuk memperbaiki kesalahan tertentu dalam rantai penalaran.

Di 5 tolok ukur dan 3 LLM, pendekatan yang ditargetkan ini mengungguli metode yang secara membabi buta mengoreksi diri sendiri.

SWE-fficiency: Bisakah Model Bahasa Mengoptimalkan Repositori Dunia Nyata pada Beban Kerja Nyata?

Pekerjaan ini memperkenalkan tolok ukur untuk menguji seberapa baik model bahasa mengoptimalkan kode dalam proyek perangkat lunak dunia nyata. Ini mencakup 498 tugas dari pustaka ML populer.

Model repositori yang diberikan harus menemukan kemacetan kinerja dan memperbaikinya.

Mereka menemukan bahwa model AI terbaik saat ini mencapai kurang dari 15% kecepatan ahli. Model kesulitan menemukan kode yang tepat untuk dioptimalkan, beralasan tentang bagaimana fungsi bekerja sama, dan menjaga pengeditan mereka bebas bug.

Ikuti kami @ritualdigest untuk informasi lebih lanjut tentang semua hal tentang penelitian crypto x AI, dan

@ritualnet untuk mempelajari lebih lanjut tentang apa yang dibangun Ritual.

788

Teratas

Peringkat

Favorit