Populární témata

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Zde je tento týden Ritual Research Digest, zpravodaj pokrývající nejnovější ve světě LLM a průnik Crypto x AI.

Se stovkami novin publikovaných týdně je nemožné mít přehled o těch nejnovějších. Čteme my, takže vy nemusíte.

RLVE: Škálování posilovaného učení pro jazykové modely s adaptivními, ověřitelnými prostředími

Autoři zavádějí RLVE pro post-trénink, kde používají "adaptivní ověřitelná prostředí", která generují problémy podle úrovně dovedností modelu.

Metoda RLVE byla testována trénováním OpenThinker3-1.5B pomocí RLVE-Gym, sbírky 400 různých vzdělávacích prostředí. Trénink s RLVE vedl ke zlepšení schopností uvažování o 3,37 % při použití 3x méně výpočetní kapacity.

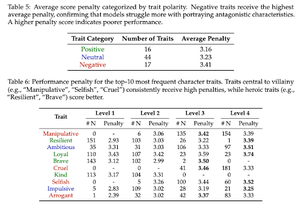

Příliš dobré, aby to bylo špatné: O neúspěchu LLM při hraní na padouchy

Tato práce zjistila, že AI modely trénované k tomu, aby byly užitečné a bezpečné, jsou ironicky "příliš dobré" na to, aby hrály padouchy. LLM klesá ve výkonu, bojují s vlastnostmi jako klamavost/manipulativnost.

Bezpečnostní soulad, který způsobuje, že AI modely odmítají škodlivé požadavky, jim zároveň brání autenticky simulovat morálně složité postavy potřebné pro úkoly jako je tvůrčí psaní, hry a společenské vědy.

Také zavádějí benchmark "Morální rolePlay" pro testování LLM.

SSR: Sokratovské samozpřesnění pro uvažování velkých jazykových modelů

Tato práce představuje SSR, který pomáhá AI modelům hodnotit uvažování tím, že rozděluje odpovědi na menší části, identifikuje, které konkrétní kroky jsou nejisté, a opravuje je.

SSR rozděluje modelové odpovědi na menší "sokratovské kroky", které jsou jako páry podotázek/pododpovědí. To umožňuje opravit konkrétní chyby v řetězci uvažování.

Na 5 benchmarkech a 3 LLM tento cílený přístup překonává metody, které se slepě samy korigují.

SWE-fficiency: Mohou jazykové modely optimalizovat reálné repozitáře na reálných pracovních zátěžích?

Tato práce představuje benchmark pro testování, jak dobře jazykové modely optimalizují kód v reálných softwarových projektech. Obsahuje 498 úloh z populárních ML knihoven.

Modely daných repozitářů musí najít výkonnostní úzká místa a opravit je.

Zjistili, že dnešní nejlepší AI modely dosahují méně než 15 % expertních zrychlení. Modely mají problém najít správný kód k optimalizaci, uvažovat o tom, jak funkce spolupracují, a udržet své úpravy bez chyb.

Sledujte nás @ritualdigest pro více informací o všem, co se týká výzkumu crypto x AI, a

@ritualnet se dozvědět více o tom, co Ritual buduje.

777

Top

Hodnocení

Oblíbené