Актуальні теми

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Ось Ritual Research Digest цього тижня, інформаційний бюлетень, який висвітлює найновіші новини у світі LLM та перетин Crypto x AI.

З сотнями газет, що публікуються щотижня, залишатися в курсі останніх неможливо. Ми читаємо, щоб вам не доводилося цього робити.

RLVE: Масштабування навчання з підкріпленням для мовних моделей з адаптивними перевіряними середовищами

Автори вводять RLVE для післятренінгу, де використовують «адаптивні перевіряні середовища», які генерують проблеми відповідно до рівня навичок моделі.

Метод RLVE було протестовано шляхом навчання OpenThinker3-1.5B за допомогою RLVE-Gym — набору з 400 різних навчальних середовищ. Навчання з RLVE призвело до покращення навичок мислення на 3,37% при використанні втричі менше обчислювальних ресурсів.

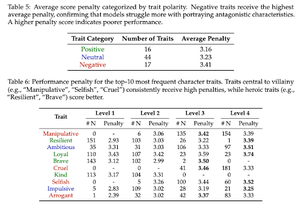

Занадто добре, щоб бути поганим: про провал LLM у ролі лиходіїв

У цій роботі встановлено, що моделі ШІ, навчені бути корисними та безпечними, іронічно, «занадто хороші» для ролювання лиходіїв. LLM втрачають продуктивність, борючись із такими рисами, як обман/маніпулятивність.

Узгодження безпеки, яке змушує моделі ШІ відмовлятися від шкідливих запитів, також заважає їм автентично імітувати морально складних персонажів, необхідних для таких завдань, як творче письмо, ігри та соціальні науки.

Вони також запровадили бенчмарк «Moral RolePlay» для тестування LLM.

SSR: Сократівське самовдосконалення для мислення на основі великої мовної моделі

Ця робота вводить SSR, який допомагає моделям ШІ оцінювати мислення, розбиваючи відповіді на менші частини, визначаючи, які конкретні кроки є хиткими, і виправляючи їх.

SSR розбиває відповідь моделі на менші «сократівські кроки», які є парами підпитання/підвідповідь. Це дозволяє виправляти конкретні помилки в ланцюжку міркування.

У 5 бенчмарках і 3 LLM цей цільовий підхід перевершує методи, які сліпо самокоригуються.

SWE-fficiency: Чи можуть мовні моделі оптимізувати реальні репозиторії на реальних робочих навантаженнях?

Ця робота вводить бенчмарк для перевірки того, наскільки добре мовні моделі оптимізують код у реальних програмних проєктах. Він містить 498 завдань із популярних бібліотек машинного навчання.

Враховуючи репозиторії, моделі повинні знаходити вузькі місця продуктивності та виправляти їх.

Вони виявили, що найкращі сучасні моделі ШІ досягають менше 15% експертного прискорення. Моделі мають труднощі з пошуком правильного коду для оптимізації, аналізуючи, як функції працюють разом, і зберігають свої правки без помилок.

Слідкуйте за нами @ritualdigest, щоб дізнатися більше про все, що стосується досліджень crypto x AI, а також

@ritualnet дізнатися більше про те, що будує Ritual.

783

Найкращі

Рейтинг

Вибране