Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Voici le Digest de Recherche Rituel de cette semaine, une newsletter couvrant les dernières nouvelles dans le monde des LLM et l'intersection entre Crypto et AI.

Avec des centaines d'articles publiés chaque semaine, il est impossible de rester à jour avec les dernières informations. Nous faisons la lecture pour que vous n'ayez pas à le faire.

RLVE : Élargir l'apprentissage par renforcement pour les modèles de langage avec des environnements vérifiables adaptatifs

Les auteurs présentent RLVE pour l'entraînement postérieur où ils utilisent des "environnements vérifiables adaptatifs" qui génèrent des problèmes en fonction du niveau de compétence des modèles.

La méthode RLVE a été testée en entraînant OpenThinker3-1.5B en utilisant RLVE-Gym, une collection de 400 environnements d'apprentissage différents. L'entraînement avec RLVE a conduit à une amélioration de 3,37 % des compétences en raisonnement tout en utilisant 3 fois moins de ressources.

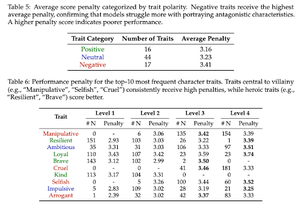

Trop bon pour être mauvais : sur l'échec des LLM à jouer des méchants

Ce travail constate que les modèles d'IA formés pour être utiles et sûrs sont ironiquement "trop bons" pour jouer des méchants. Les LLMs déclinent en performance, peinant avec des traits comme la tromperie/manipulation.

L'alignement de la sécurité qui amène les modèles d'IA à refuser des demandes nuisibles les empêche également de simuler authentiquement des personnages moralement complexes nécessaires pour des tâches telles que l'écriture créative, les jeux et les sciences sociales.

Ils introduisent également un benchmark "Moral RolePlay" pour tester les LLM.

SSR : Socratic Self-Refine pour le raisonnement des grands modèles de langage

Ce travail introduit SSR, qui aide les modèles d'IA à évaluer le raisonnement en décomposant les réponses en morceaux plus petits, en identifiant quelles étapes spécifiques sont fragiles et en les corrigeant.

SSR décompose la réponse du modèle en plus petites "étapes socratiques", qui sont comme des paires de sous-questions/sous-réponses. Cela permet de corriger des erreurs spécifiques dans la chaîne de raisonnement.

Sur 5 benchmarks et 3 LLMs, cette approche ciblée surpasse les méthodes qui se corrigent aveuglément.

SWE-fficiency : Les modèles de langage peuvent-ils optimiser des dépôts réels sur des charges de travail réelles ?

Ce travail introduit un benchmark pour tester l'efficacité des modèles de langage à optimiser le code dans des projets logiciels réels. Il comprend 498 tâches provenant de bibliothèques ML populaires.

Les modèles de repos donnés doivent identifier les goulets d'étranglement de performance et les corriger.

Ils constatent que les meilleurs modèles d'IA d'aujourd'hui atteignent moins de 15 % des accélérations de vitesse des experts. Les modèles ont du mal à localiser le bon code à optimiser, à raisonner sur la façon dont les fonctions interagissent et à garder leurs modifications sans bogues.

Suivez-nous @ritualdigest pour en savoir plus sur tout ce qui concerne la crypto et la recherche en IA, et @ritualnet pour en apprendre davantage sur ce que Ritual est en train de construire.

780

Meilleurs

Classement

Favoris