Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Hier ist der Ritual Research Digest dieser Woche, ein Newsletter, der die neuesten Entwicklungen in der Welt der LLMs und der Schnittstelle von Crypto x AI abdeckt.

Mit Hunderten von wöchentlich veröffentlichten Arbeiten ist es unmöglich, auf dem neuesten Stand zu bleiben. Wir lesen für Sie, damit Sie es nicht müssen.

RLVE: Skalierung von Reinforcement Learning für Sprachmodelle mit adaptiven verifizierbaren Umgebungen

Die Autoren stellen RLVE für das Nachtraining vor, bei dem sie "adaptive verifizierbare Umgebungen" verwenden, die Probleme entsprechend dem Fähigkeitsniveau des Modells generieren.

Die RLVE-Methode wurde getestet, indem OpenThinker3-1.5B mit RLVE-Gym trainiert wurde, einer Sammlung von 400 verschiedenen Lernumgebungen. Das Training mit RLVE führte zu einer Verbesserung der Denkfähigkeiten um 3,37 %, während 3x weniger Rechenleistung verwendet wurde.

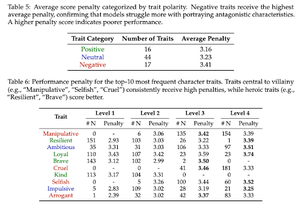

Zu gut, um schlecht zu sein: Über das Versagen von LLMs, Bösewichte zu spielen

Diese Arbeit zeigt, dass KI-Modelle, die darauf trainiert sind, hilfreich und sicher zu sein, ironischerweise "zu gut" sind, um Bösewichte zu spielen. LLMs zeigen eine Leistungsabnahme und haben Schwierigkeiten mit Eigenschaften wie betrügerisch/manipulativ.

Die Sicherheitsausrichtung, die KI-Modelle dazu bringt, schädliche Anfragen abzulehnen, verhindert auch, dass sie authentisch moralisch komplexe Charaktere simulieren, die für Aufgaben wie kreatives Schreiben, Spiele und Sozialwissenschaften benötigt werden.

Sie führen auch einen "Moral RolePlay"-Benchmark ein, um LLMs zu testen.

SSR: Socratic Self-Refine für das Denken großer Sprachmodelle

Diese Arbeit führt SSR ein, das KI-Modellen hilft, das Denken zu bewerten, indem Antworten in kleinere Teile zerlegt werden, spezifische unsichere Schritte identifiziert und diese behoben werden.

SSR zerlegt die Modellantwort in kleinere "sokratische Schritte", die wie Unterfragen/Unterantworten-Paare sind. Dies ermöglicht es, spezifische Fehler in der Argumentationskette zu beheben.

Über 5 Benchmarks und 3 LLMs hinweg übertrifft dieser gezielte Ansatz Methoden, die blind selbst korrigieren.

SWE-Effizienz: Können Sprachmodelle reale Repositories unter realen Arbeitslasten optimieren?

Diese Arbeit führt einen Benchmark ein, um zu testen, wie gut Sprachmodelle Code in realen Softwareprojekten optimieren. Sie umfasst 498 Aufgaben aus beliebten ML-Bibliotheken.

Gegebene Repos-Modelle müssen Leistungsengpässe finden und beheben.

Sie stellen fest, dass die besten KI-Modelle von heute weniger als 15 % der Geschwindigkeitssteigerungen von Experten erreichen. Die Modelle haben Schwierigkeiten, den richtigen Code zur Optimierung zu finden, darüber nachzudenken, wie Funktionen zusammenarbeiten, und ihre Änderungen fehlerfrei zu halten.

Folge uns @ritualdigest für mehr über alles, was mit Krypto x AI-Forschung zu tun hat, und @ritualnet, um mehr darüber zu erfahren, was Ritual aufbaut.

782

Top

Ranking

Favoriten