Argomenti di tendenza

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Ecco il Digest di Ricerca Rituale di questa settimana, una newsletter che copre le ultime novità nel mondo dei LLM e l'intersezione tra Crypto e AI.

Con centinaia di articoli pubblicati settimanalmente, rimanere aggiornati con le ultime novità è impossibile. Noi facciamo la lettura così non dovete farlo voi.

RLVE: Scalare l'apprendimento per rinforzo per modelli di linguaggio con ambienti verificabili adattivi

Gli autori introducono RLVE per il post training dove utilizzano "ambienti verificabili adattivi" che generano problemi in base al livello di abilità del modello.

Il metodo RLVE è stato testato addestrando OpenThinker3-1.5B utilizzando RLVE-Gym, una raccolta di 400 diversi ambienti di apprendimento. L'addestramento con RLVE ha portato a un miglioramento del 3,37% nelle capacità di ragionamento utilizzando 3 volte meno risorse di calcolo.

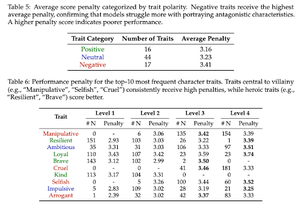

Troppo buoni per essere cattivi: sul fallimento dei LLM nel fare il ruolo dei cattivi

Questo lavoro scopre che i modelli di intelligenza artificiale addestrati per essere utili e sicuri sono ironicamente "troppo buoni" per interpretare i cattivi. I LLM mostrano un calo delle prestazioni, faticando con tratti come ingannevole/manipolativo.

L'allineamento alla sicurezza che fa sì che i modelli di AI rifiutino richieste dannose impedisce anche loro di simulare autenticamente personaggi moralmente complessi necessari per compiti come la scrittura creativa, i giochi e le scienze sociali.

Introducono anche un benchmark "Moral RolePlay" per testare i LLM.

SSR: Auto-Riflessione Socratica per il Ragionamento dei Modelli di Linguaggio di Grandi Dimensioni

Questo lavoro introduce SSR, che aiuta i modelli di intelligenza artificiale a valutare il ragionamento suddividendo le risposte in pezzi più piccoli, identificando quali passaggi specifici sono incerti e correggendoli.

SSR scompone la risposta del modello in "passi socratici" più piccoli, che sono come coppie di sotto-domande/sotto-risposte. Questo consente di correggere errori specifici nella catena di ragionamento.

In 5 benchmark e 3 LLM, questo approccio mirato supera i metodi che si autocorreggono ciecamente.

SWE-fficienza: I modelli linguistici possono ottimizzare i repository del mondo reale su carichi di lavoro reali?

Questo lavoro introduce un benchmark per testare quanto bene i modelli linguistici ottimizzano il codice in progetti software del mondo reale. Include 498 compiti da popolari librerie di ML.

I modelli dati devono trovare i colli di bottiglia delle prestazioni e risolverli.

Scoprono che i migliori modelli di AI di oggi raggiungono meno del 15% dei miglioramenti di velocità degli esperti. I modelli faticano a individuare il codice giusto da ottimizzare, a ragionare su come le funzioni lavorano insieme e a mantenere le loro modifiche prive di bug.

Seguici su @ritualdigest per ulteriori informazioni su tutto ciò che riguarda la ricerca crypto x AI, e

@ritualnet per saperne di più su cosa sta costruendo Ritual.

786

Principali

Ranking

Preferiti