Актуальные темы

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Вот дайджест Ritual Research за эту неделю, информационный бюллетень, охватывающий последние события в мире LLM и пересечении Crypto x AI.

С сотнями статей, публикуемых еженедельно, оставаться в курсе последних новостей невозможно. Мы читаем, чтобы вам не пришлось.

RLVE: Масштабирование обучения с подкреплением для языковых моделей с адаптивными проверяемыми средами

Авторы представляют RLVE для постобучения, где они используют "адаптивные проверяемые среды", которые генерируют задачи в соответствии с уровнем навыков модели.

Метод RLVE был протестирован на модели OpenThinker3-1.5B с использованием RLVE-Gym, коллекции из 400 различных учебных сред. Обучение с помощью RLVE привело к улучшению навыков рассуждения на 3,37%, при этом было использовано в 3 раза меньше вычислительных ресурсов.

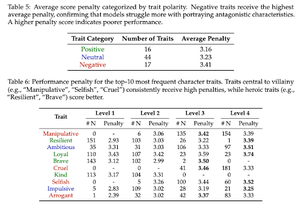

Слишком хороши, чтобы быть плохими: о неудаче LLM в роли злодеев

В этой работе выясняется, что модели ИИ, обученные быть полезными и безопасными, иронично "слишком хороши", чтобы играть роль злодеев. LLMs теряют в производительности, испытывая трудности с такими чертами, как обманчивость/манипулятивность.

Безопасная настройка, которая заставляет модели ИИ отказываться от вредоносных запросов, также мешает им аутентично симулировать морально сложные персонажи, необходимые для таких задач, как креативное письмо, игры и социальные науки.

Они также вводят эталон "Моральная Ролевка" для тестирования LLM.

SSR: Сократическое самоусовершенствование для рассуждений больших языковых моделей

Данная работа представляет SSR, который помогает ИИ моделям оценивать рассуждения, разбивая ответы на более мелкие части, выявляя, какие конкретные шаги являются ненадежными, и исправляя их.

SSR разбивает ответ модели на более мелкие "Сократические шаги", которые представляют собой пары под-вопрос/под-ответ. Это позволяет исправлять конкретные ошибки в цепочке рассуждений.

На 5 бенчмарках и 3 LLM этот целенаправленный подход превосходит методы, которые слепо самокорректируются.

SWE-fficiency: Могут ли языковые модели оптимизировать репозитории в реальном мире на реальных нагрузках?

В этой работе представлен бенчмарк для тестирования того, насколько хорошо языковые модели оптимизируют код в реальных программных проектах. Он включает 498 задач из популярных библиотек машинного обучения.

Модели репозиториев должны находить узкие места в производительности и исправлять их.

Они обнаруживают, что лучшие AI модели сегодня достигают менее 15% ускорения по сравнению с экспертами. Модели испытывают трудности с нахождением правильного кода для оптимизации, пониманием того, как функции работают вместе, и поддержанием своих правок без ошибок.

Подписывайтесь на нас @ritualdigest, чтобы узнать больше о всем, что связано с криптовалютой и исследованиями в области ИИ, а также @ritualnet, чтобы узнать больше о том, что строит Ritual.

791

Топ

Рейтинг

Избранное