Temas en tendencia

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Aquí está el Ritual Research Digest de esta semana, un boletín que cubre lo último en el mundo de los LLM y la intersección de Crypto x AI.

Con cientos de artículos publicados semanalmente, mantenerse al día con los últimos es imposible. Hacemos la lectura para que usted no tenga que hacerlo.

RLVE: Ampliando el aprendizaje por refuerzo para modelos de lenguaje con entornos adaptativos verificables

Los autores introducen RLVE para el post-entrenamiento, donde utilizan "entornos adaptativos verificables" que generan problemas según el nivel de habilidad del modelo.

El método RLVE se probó entrenando OpenThinker3-1.5B usando RLVE-Gym, una colección de 400 entornos de aprendizaje diferentes. Entrenar con RLVE llevó a una mejora del 3,37% en las habilidades de razonamiento usando 3 veces menos cálculo.

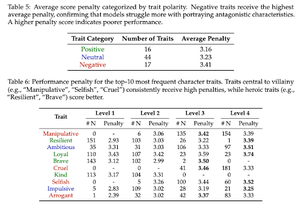

Demasiado bueno para ser malo: Sobre el fracaso de los LLM para interpretar villanos

Este trabajo concluye que los modelos de IA entrenados para ser útiles y seguros son, irónicamente, "demasiado buenos" para interpretar villanos. Los LLM tienen un rendimiento decaente, luchando con rasgos como engañoso o manipulador.

La alineación de seguridad que hace que los modelos de IA rechacen solicitudes dañinas también les impide simular auténticamente personajes moralmente complejos necesarios para tareas como la escritura creativa, los juegos y las ciencias sociales.

También introducen un benchmark de "Rol Moral" para probar los LLMs.

SSR: Autorefinamiento Socrático para el razonamiento de grandes modelos de lenguaje

Este trabajo introduce SSR, que ayuda a los modelos de IA a evaluar el razonamiento dividiendo las respuestas en partes más pequeñas, identificando qué pasos específicos son inestables y corrigiéndolos.

SSR descompone la respuesta del modelo en "pasos socráticos" más pequeños, que son como pares subpregunta/subrespuesta. Esto permite corregir errores específicos en la cadena de razonamiento.

A lo largo de 5 benchmarks y 3 LLMs, este enfoque dirigido supera a los métodos que se autocorrigen ciegamente.

Eficiencia de software: ¿Pueden los modelos de lenguaje optimizar repositorios del mundo real sobre cargas de trabajo reales?

Este trabajo introduce un benchmark para probar qué tan bien los modelos de lenguaje optimizan el código en proyectos de software reales. Incluye 498 tareas de librerías populares de ML.

Dadas las modelos de repositorios deben encontrar cuellos de botella de rendimiento y corregirlos.

Descubren que los mejores modelos de IA actuales logran menos del 15% de las aceleraciones de los expertos. Los modelos luchan por localizar el código adecuado para optimizar, razonar sobre cómo funcionan las funciones entre sí y mantener sus ediciones libres de errores.

Síganos @ritualdigest para obtener más información sobre todo lo relacionado con la investigación de cripto x IA, y

@ritualnet para obtener más información sobre lo que Ritual está construyendo.

782

Populares

Ranking

Favoritas