热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

这是本周的仪式研究摘要,一份涵盖LLM世界和加密与AI交集最新动态的通讯。

每周有数百篇论文发表,跟上最新动态几乎是不可能的。我们为您阅读,所以您无需这样做。

RLVE:为语言模型扩展强化学习,采用自适应可验证环境

作者介绍了RLVE用于后期训练,其中使用了"自适应可验证环境",根据模型的技能水平生成问题。

RLVE 方法通过使用 RLVE-Gym 训练 OpenThinker3-1.5B 进行了测试,RLVE-Gym 是一个包含 400 种不同学习环境的集合。使用 RLVE 进行训练使推理能力提高了 3.37%,同时计算资源使用减少了 3 倍。

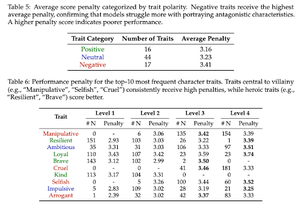

太好以至于不好:关于大型语言模型在扮演反派角色时的失败

这项工作发现,经过训练以提供帮助和安全的AI模型,讽刺地说,"太好"以至于无法扮演反派角色。大型语言模型的表现下降,难以处理像欺骗/操控这样的特质。

安全对齐使得AI模型拒绝有害请求,但也阻止了它们真实地模拟道德复杂的角色,这些角色在创意写作、游戏和社会科学等任务中是必需的。

他们还引入了一个"道德角色扮演"基准来测试大型语言模型(LLMs)。

SSR:用于大型语言模型推理的苏格拉底自我精炼

这项工作介绍了SSR,它帮助AI模型通过将答案分解为更小的部分,识别哪些具体步骤不稳固,并加以修正,从而评估推理。

SSR 将模型响应分解为更小的 "苏格拉底步骤",这些步骤类似于子问题/子答案对。这使得可以修正推理链中的特定错误。

在 5 个基准和 3 个 LLM 中,这种有针对性的方法优于盲目自我纠正的方法。

SWE-效率:语言模型能否在真实工作负载上优化真实世界的代码库?

这项工作引入了一个基准,以测试语言模型在真实软件项目中优化代码的能力。它包括来自流行机器学习库的498个任务。

给定的仓库模型必须找到性能瓶颈并修复它们。

他们发现,今天最好的 AI 模型的加速效果不到专家的 15%。这些模型在定位需要优化的正确代码、推理函数如何协同工作以及保持编辑无错误方面都面临困难。

关注我们 @ritualdigest,获取更多关于加密货币与 AI 研究的内容,

以及 @ritualnet,了解 Ritual 正在构建的内容。

789

热门

排行

收藏