Populære emner

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Her er denne ukens Ritual Research Digest, et nyhetsbrev som dekker det siste i verden av LLM-er og skjæringspunktet mellom Crypto x AI.

Med hundrevis av artikler utgitt ukentlig, er det umulig å holde seg oppdatert med det siste. Vi leser slik at du ikke trenger å gjøre det.

RLVE: Skalering av forsterkningslæring for språkmodeller med adaptive verifiserbare miljøer

Forfatterne introduserer RLVE for ettertrening, hvor de bruker «adaptive, verifiserbare miljøer» som genererer problemer i henhold til modellens ferdighetsnivå.

RLVE-metoden ble testet ved å trene OpenThinker3-1.5B ved bruk av RLVE-Gym, en samling av 400 forskjellige læringsmiljøer. Trening med RLVE førte til en forbedring på 3,37 % i resonnementsferdigheter samtidig som man brukte 3 ganger mindre beregning.

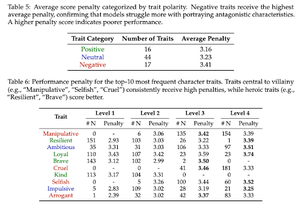

For god til å være dårlig: Om at LLM-er ikke klarer å rollespille skurker

Dette arbeidet finner at AI-modeller trent til å være hjelpsomme og trygge ironisk nok er «for gode» til å rollespille skurker. LLM-er synker i ytelse, og sliter med trekk som bedragersk/manipulerende.

Sikkerhetsjustering som får AI-modeller til å avvise skadelige forespørsler, hindrer dem også i å autentisk simulere moralsk komplekse karakterer som trengs for oppgaver som kreativ skriving, spill og samfunnsvitenskap.

De introduserer også en "Moral RolePlay"-benchmark for å teste LLM-er.

SSR: Sokratisk selvforbedring for resonnement i store språkmodeller

Dette arbeidet introduserer SSR, som hjelper AI-modeller med å vurdere resonnement ved å dele opp svar i mindre deler, identifisere hvilke spesifikke steg som er ustabile, og rette dem.

SSR deler opp modellens respons i mindre «sokratiske steg», som er som underspørsmål/under-svar-par. Dette gjør det mulig å rette spesifikke feil i resonnementskjeden.

På tvers av 5 benchmarks og 3 LLM-er overgår denne målrettede tilnærmingen metoder som blindt korrigerer seg selv.

SWE-tilstrekkelighet: Kan språkmodeller optimalisere virkelige repositorier på reelle arbeidsbelastninger?

Dette arbeidet introduserer en benchmark for å teste hvor godt språkmodeller optimaliserer kode i virkelige programvareprosjekter. Den inkluderer 498 oppgaver fra populære ML-biblioteker.

Gitte repos-modeller må finne ytelsesflaskehalser og fikse dem.

De finner at dagens beste AI-modeller oppnår mindre enn 15 % av eksperthastighetene. Modellene sliter med å finne riktig kode for å optimalisere, resonnere om hvordan funksjoner fungerer sammen, og holde redigeringene sine feilfrie.

Følg oss @ritualdigest for mer om alt som har med krypto x AI-forskning å gjøre, og

@ritualnet lære mer om hva Ritual bygger.

778

Topp

Rangering

Favoritter