トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

今週の Ritual Research Digest は、LLM の世界の最新情報と Crypto x AI の交差点をカバーするニュースレターです。

毎週何百もの論文が発行されているため、最新の情報を入手することは不可能です。私たちはあなたがその必要を省くように読書を行います。

RLVE:適応的検証可能環境を持つ言語モデルのための強化学習の拡大

著者らは、モデルのスキルレベルに応じて問題を生成する「適応的検証可能環境」を用いるポストトレーニングにRLVEを導入しています。

RLVEメソッドは、400の異なる学習環境からなるRLVE-Gymを使ってOpenThinker3-1.5Bをトレーニングすることでテストされました。RLVEでのトレーニングにより、計算量を3倍に抑えながら推論力が3.37%向上しました。

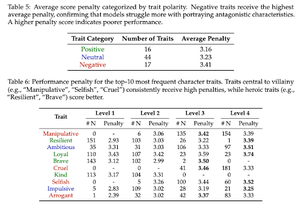

悪くないほど良すぎる:LLMが悪役をロールプレイできないことについて

この研究では、役に立ち安全に訓練されたAIモデルは皮肉にも悪役を演じるには「強すぎる」ことが判明しています。LLMはパフォーマンスが低下し、欺瞞的・操作的な特性に苦しみます。

AIモデルが有害な要求を拒否する安全整合性は、創作、ゲーム、社会科学などの課題に必要な道徳的に複雑なキャラクターを本物にシミュレートすることを妨げます。

また、LLMのテストに「モラルロールプレイ」ベンチマークも導入しています。

SSR:大規模言語モデル推論のためのソクラテス式自己洗練

この研究ではSSRが導入され、AIモデルが解答を小さな断片に分解し、どの特定のステップが不安定かを特定し、それを修正することで推論を評価します。

SSRはモデルの回答をより小さな「ソクラテス的なステップ」に分解し、これはサブ質問とサブ回答のペアのようなものです。これにより、推論連鎖の特定の誤りを修正することが可能になります。

5つのベンチマークと3つのLLMを対象とし、このターゲットを絞ったアプローチは、盲目的に自己修正を行う手法を上回っています。

SWE効率性:言語モデルは実際のワークロード上で実際のリポジトリを最適化できるのか?

本研究では、実際のソフトウェアプロジェクトにおける言語モデルがどれだけコードを最適化するかを検証するためのベンチマークを導入しています。人気のMLライブラリから498のタスクが含まれています。

特定のリポジトリモデルはパフォーマンスのボトルネックを見つけて修正しなければなりません。

彼らは、今日の最高のAIモデルは専門家の速度アップの15%未満しか達成していないことを発見しました。モデルは最適化すべき適切なコードを見つけ、関数の連携を推理し、編集をバグなしで保つのに苦労しています。

暗号通貨 x AI 研究に関するすべての詳細については、@ritualdigest をフォローしてください。

@ritualnet Ritualが構築しているものについて詳しく知りたい。

785

トップ

ランキング

お気に入り