Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Oto najnowszy Digest Ritual Research, newsletter obejmujący najnowsze wydarzenia w świecie LLM-ów oraz na styku Crypto x AI.

Z setkami publikacji co tydzień, niemożliwe jest nadążanie za nowinkami. My czytamy, abyś nie musiał.

RLVE: Skalowanie uczenia przez wzmocnienie dla modeli językowych z adaptacyjnymi weryfikowalnymi środowiskami

Autorzy wprowadzają RLVE do post-treningu, gdzie wykorzystują "adaptacyjne weryfikowalne środowiska", które generują problemy zgodnie z poziomem umiejętności modeli.

Metoda RLVE została przetestowana poprzez szkolenie OpenThinker3-1.5B przy użyciu RLVE-Gym, zbioru 400 różnych środowisk uczenia się. Szkolenie z RLVE doprowadziło do 3,37% poprawy umiejętności rozumowania przy użyciu 3 razy mniejszej mocy obliczeniowej.

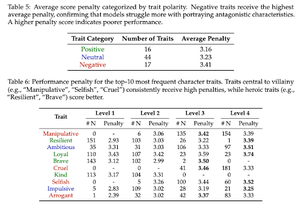

Zbyt dobre, by być złe: O niepowodzeniu LLM w odgrywaniu ról złoczyńców

Ta praca stwierdza, że modele AI szkolone, aby być pomocne i bezpieczne, są ironicznie "zbyt dobre", aby odgrywać złoczyńców. LLM-y spadają w wydajności, zmagając się z cechami takimi jak oszukańczość/manipulacja.

Dostosowanie bezpieczeństwa, które sprawia, że modele AI odrzucają szkodliwe prośby, uniemożliwia im również autentyczne symulowanie moralnie złożonych postaci potrzebnych do zadań takich jak twórcze pisanie, gry i nauki społeczne.

Wprowadzają również benchmark "Moral RolePlay" do testowania LLM.

SSR: Socratic Self-Refine dla rozumowania dużych modeli językowych

Ta praca wprowadza SSR, które pomaga modelom AI oceniać rozumowanie, dzieląc odpowiedzi na mniejsze części, identyfikując, które konkretne kroki są niepewne, i naprawiając je.

SSR dzieli odpowiedź modelu na mniejsze "kroki sokratejskie", które są jak pary podpytań/pododpowiedzi. Umożliwia to naprawę konkretnych błędów w łańcuchu rozumowania.

Na 5 benchmarkach i 3 LLM-ach, to ukierunkowane podejście przewyższa metody, które ślepo się samokorygują.

SWE-fficiency: Czy modele językowe mogą optymalizować repozytoria w rzeczywistych obciążeniach?

Ta praca wprowadza benchmark do testowania, jak dobrze modele językowe optymalizują kod w rzeczywistych projektach oprogramowania. Zawiera 498 zadań z popularnych bibliotek ML.

Modele repozytoriów muszą znaleźć wąskie gardła wydajności i je naprawić.

Odkrywają, że dzisiejsze najlepsze modele AI osiągają mniej niż 15% przyspieszenia ekspertów. Modele mają trudności z lokalizowaniem odpowiedniego kodu do optymalizacji, rozumieniem, jak funkcje współdziałają, oraz utrzymywaniem swoich poprawek wolnymi od błędów.

Śledź nas @ritualdigest, aby uzyskać więcej informacji na temat wszystkiego, co związane z kryptowalutami i badaniami AI, oraz @ritualnet, aby dowiedzieć się więcej o tym, co buduje Ritual.

779

Najlepsze

Ranking

Ulubione