Populære emner

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

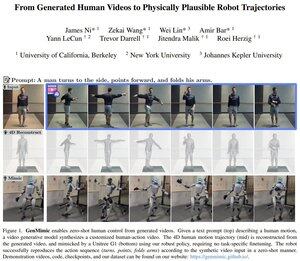

Er dette Yann LeCuns første artikkel etter at han forlot Meta?

Den demonstrerer hvordan humanoide roboter kan etterligne handlinger fra AI-genererte videoer, som ofte er for støyende til direkte imitasjon.

Systemet løfter videoen opp i 3D-nøkkelpunkter og bruker deretter en fysikkbevisst policy for å utføre bevegelsene, noe som muliggjør null-skudd-kontroll.

De implementerte dette på Unitree G1 humanoid robot.

Topp

Rangering

Favoritter