Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

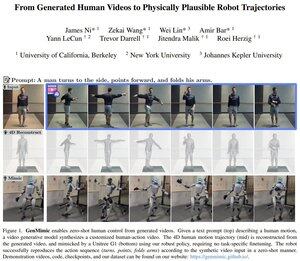

Ist dies Yann LeCuns erstes Paper nach dem Verlassen von Meta?

Es zeigt, wie humanoide Roboter Aktionen aus KI-generierten Videos nachahmen können, die oft zu laut sind, um direkt imitiert zu werden.

Das System hebt das Video in 3D-Schlüsselpositionen an und verwendet dann eine physikbewusste Strategie, um die Bewegungen auszuführen, was eine Zero-Shot-Kontrolle ermöglicht.

Sie haben dies auf dem humanoiden Roboter Unitree G1 implementiert.

Top

Ranking

Favoriten