熱門話題

#

Bonk 生態迷因幣展現強韌勢頭

#

有消息稱 Pump.fun 計劃 40 億估值發幣,引發市場猜測

#

Solana 新代幣發射平臺 Boop.Fun 風頭正勁

這是本週的儀式研究摘要,一份涵蓋LLM世界和加密與AI交集最新動態的通訊。

每週有數百篇論文發表,跟上最新動態幾乎是不可能的。我們為您閱讀,所以您無需這樣做。

Think-at-Hard: 選擇性潛在迭代以改善推理語言模型

動態潛在迭代是困難的:它需要完整的上下文、自適應目標、參數重用,但策略質量的耦合會導致訓練不穩定。

這項工作介紹了 TaH,動態潛在思維僅針對硬標記進行迭代,通過開發專門的模型架構和穩定的訓練方法,選擇性地應用潛在迭代。

從 Qwen3-0.6/1.7B-Base 微調而來,TaH 在 5 個推理基準上達到了 +4% 的提升。

P1:利用強化學習掌握物理奧林匹克

本研究介紹了P1,一系列開源物理推理模型。它們整合了訓練時和測試時的擴展,確保在推理時自適應部署更強的推理能力。

P1 模型是在多階段強化學習框架中,僅通過對基礎語言模型進行後訓練來訓練的。在測試時,它們將 P1 模型與 PhysicsMinions 代理框架結合。

它們的模型 P1-235B-A22B 在 2025 年 IPhO 中達到了金牌表現。

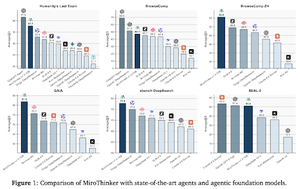

MiroThinker:透過模型、上下文和互動擴展推動開源研究代理的性能邊界

這篇論文介紹了一個研究代理,推動在三個維度上的性能:模型大小、上下文長度和互動深度。

為了維持深度推理過程,該模型配備了256K的上下文窗口和每個任務最多600次的工具調用。

MiroThinker v1.0配備了一個簡單的ReAct代理,在開源研究代理中達到了SOTA性能。

成為一個優秀的 AI 研究代理需要什麼?研究創意多樣性的角色

本文提出了量化和控制代理創意多樣性的方法。代理架構的選擇對創意多樣性有著重要影響。

通過受控的實驗設計,他們建立了因果關係,顯示出增加創意多樣性會改善在MLE-bench任務上的表現。他們在使用替代性能指標進行評估時也建立了穩健性。

DR Tulu:使用演變標準的強化學習進行深度研究

本文訓練了深度研究 Tulu(DR Tulu-8B),專為開放式、長篇深度研究任務而設。

為了解決長格式任務中的驗證問題,DR-Tulu 在高質量用戶數據上進行微調,然後通過隨著標準演變的強化學習(RLER)進行訓練,其中標準在訓練過程中與策略模型共同演變。他們獲得的結果超過了最強的開放 8-32 模型。

關注我們 @ritualdigest 獲取有關加密貨幣與 AI 研究的更多資訊,並且

@ritualnet 了解 Ritual 正在構建的內容。

3K

熱門

排行

收藏