热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

这是本周的仪式研究摘要,一份涵盖LLM世界和加密与AI交集最新动态的通讯。

每周有数百篇论文发表,跟上最新动态几乎是不可能的。我们为您阅读,所以您无需这样做。

Think-at-Hard:选择性潜在迭代以改善推理语言模型

动态潜在迭代很难:它需要完整的上下文、自适应目标、参数重用,但策略质量耦合会导致训练不稳定。

这项工作介绍了 TaH,一种动态潜在思维,仅通过开发专门的模型架构和稳定的训练方法,对硬令牌进行迭代,选择性地应用潜在迭代。

从 Qwen3-0.6/1.7B-Base 微调而来,TaH 在 5 个推理基准上实现了 +4% 的提升。

P1:通过强化学习掌握物理奥林匹克

这项工作介绍了P1,一个开源物理推理模型的家族。它们集成了训练时和测试时的缩放,确保在推理时自适应地部署更强的推理能力。

P1 模型是在多阶段强化学习框架中,基于基础语言模型进行后期训练的纯强化学习模型。在测试时,它们将 P1 模型与 PhysicsMinions 代理框架结合。

它们的模型 P1-235B-A22B 在 2025 年国际物理奥林匹克竞赛中取得了金牌表现。

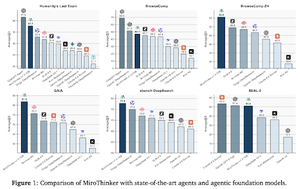

MiroThinker:通过模型、上下文和交互扩展推动开源研究代理的性能边界

本文介绍了一种研究代理,在模型大小、上下文长度和交互深度三个维度上推动性能。

为了维持深度推理过程,该模型配备了256K的上下文窗口和每个任务最多600次工具调用。

MiroThinker v1.0配备了一个简单的ReAct代理,在开源研究代理中实现了SOTA性能。

成为一名优秀的AI研究代理需要什么?研究创意多样性的角色

本文提出了量化和控制代理创意多样性的方法。代理框架的选择对创意多样性有显著影响。

通过控制实验设计,他们建立了因果关系,表明增加创意多样性会提高在MLE-bench任务上的表现。他们在使用替代性能指标进行评估时也建立了稳健性。

DR Tulu:使用演变评分标准进行深度研究的强化学习

本文训练了用于开放式、长篇深度研究任务的深度研究 Tulu(DR Tulu-8B)。

为了在长格式任务中进行验证,DR-Tulu 在高质量用户数据上进行了微调,然后通过与不断演变的标准(RLER)进行强化学习训练,在此过程中,标准与策略模型在训练期间共同演变。它们获得的结果优于最强的开放 8-32 模型。

关注我们 @ritualdigest,获取更多关于加密货币与 AI 研究的内容,

以及 @ritualnet,了解 Ritual 正在构建的内容。

3.01K

热门

排行

收藏