المواضيع الرائجة

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

إليك ملخص Ritual Research Digest لهذا الأسبوع ، وهي نشرة إخبارية تغطي أحدث ما في عالم LLMs وتقاطع Crypto x الذكاء الاصطناعي.

مع نشر مئات الصحف أسبوعيا ، من المستحيل البقاء على اطلاع دائم بالأحدث الصحف. نقوم بالقراءة حتى لا تضطر إلى ذلك.

التفكير بجد: تكرارات انتقائية كامنة لتحسين نماذج لغوية التفكير

التكرار الكامن الديناميكي صعب: يحتاج إلى السياق الكامل، والأهداف التكيفية وإعادة استخدام المعلمات، لكن الاقتران بجودة السياسات يسبب عدم استقرار التدريب.

يقدم هذا العمل TaH، وهو التفكير الكامن الديناميكي الذي يكرر فقط على الرموز الصلبة من خلال تطوير قوس نموذج متخصص وطريقة تدريب مستقرة، مع تطبيق التكرار الكامن بشكل انتقائي.

بعد تعديله بدقة من Qwen3-0.6/1.7B-Base، تحقق TaH +4٪ عبر 5 اختبارات منطقية.

P1: إتقان أولمبيادات الفيزياء مع التعلم المعزز

يقدم هذا العمل P1، وهي عائلة من نماذج التفكير الفيزيائي في OSS. تدمج كل من مقياس وقت التدريب ووقت الاختبار، مما يضمن قدرة استدلال أقوى تطبق بشكل تكيفي عند الاستنتاج.

يتم تدريب نماذج P1 فقط من خلال التدريب بعد التعلم الواقعي على أنظمة التعلم القائم في إطار عمل التعلم المعزز متعدد المراحل. بالنسبة لوقت الاختبار، يجمعون بين نماذج P1 وإطار عمل وكلاء PhysicsMinions.

يحقق طراز P1-235B-A22B أداء ميداليا ذهبية على آيفون 2025.

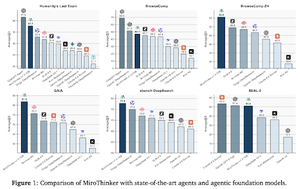

MiroThinker: دفع حدود أداء وكلاء البحث مفتوح المصدر من خلال النموذج والسياق والتوسع التفاعلي

تقدم الورقة وكيل بحث يدفع الأداء على ثلاثة أبعاد: حجم النموذج، طول السياق، وعمق التفاعل.

للحفاظ على عمليات التفكير العميق، مزود النموذج بنافذة سياق بطول 256K وما يصل إلى 600 استدعاء أدوات لكل مهمة.

MiroThinker v1.0، المزود بعامل ReAct بسيط، يحقق أداء SOTA بين وكلاء البحث مفتوحي المصدر.

ما الذي يتطلبه الأمر لتكون وكيل بحث جيد في مجال الذكاء الاصطناعي؟ دراسة دور تنوع الأفكار

تقترح هذه الورقة طرقا لقياس والتحكم في تنوع الأفكار لدى الوكيل. اختيار الهيكل الوكيلي يؤثر بشكل كبير على تنوع الأفكار.

من خلال تصميم تجريبي محكم، يؤسسون علاقة سببية، مما يثبت أن زيادة تنوع الأفكار يؤدي إلى تحسين الأداء في مهام MLE-bench. كما أنها تثبت المتانة عند تقييمها باستخدام مقاييس أداء بديلة.

د. ي. تولو: التعلم المعزز مع معايير متطورة للبحث العميق

تدرب هذه الورقة البحث العميق الذي تم تدريبه على مهام البحث العميق المفتوحة وطويلة المدى.

لمعالجة التحقق في المهام الطويلة، يتم ضبط DR-Tulu بدقة على بيانات المستخدمين عالية الجودة، ثم يتم تدريبه عبر التعلم المعزز مع معايير متطورة (RLER)، حيث تتطور المعايير مع نموذج السياسة أثناء التدريب. يحصلون على نتائج أفضل من أقوى نماذج 8-32 المفتوحة.

تابعنا @ritualdigest لمعرفة المزيد حول كل ما يتعلق بالبحث عن العملات المشفرة x الذكاء الاصطناعي ، و

@ritualnet لمعرفة المزيد حول ما تبنيه Ritual.

3K

الأفضل

المُتصدِّرة

التطبيقات المفضلة