Актуальные темы

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Вот дайджест Ritual Research за эту неделю, информационный бюллетень, охватывающий последние события в мире LLM и пересечении Crypto x AI.

С сотнями статей, публикуемых еженедельно, оставаться в курсе последних новостей невозможно. Мы читаем, чтобы вам не пришлось.

Think-at-Hard: Селективные латентные итерации для улучшения языковых моделей рассуждений

Динамическая латентная итерация сложна: она требует полного контекста, адаптивных целей, повторного использования параметров, но связь качества политики вызывает нестабильность обучения.

Эта работа представляет TaH, динамическое латентное мышление, которое итеративно работает только с жесткими токенами, разрабатывая специализированную архитектуру модели и стабильный метод обучения, избирательно применяя латентную итерацию.

Финетюнинг от Qwen3-0.6/1.7B-Base, TaH достигает +4% по 5 критериям рассуждения.

P1: Освоение физики на Олимпиадах с помощью обучения с подкреплением

В данной работе представлен P1, семейство моделей OSS для физического рассуждения. Они интегрируют как масштабирование во время обучения, так и во время тестирования, обеспечивая более сильные способности к рассуждению, адаптивно развертываемые при выводе.

Модели P1 обучаются исключительно с помощью RL после обучения на базовых LM в многоступенчатой структуре RL. Для тестирования они комбинируют модели P1 с агентской структурой PhysicsMinions.

Их модель P1-235B-A22B достигает золотого медального результата на IPhO 2025.

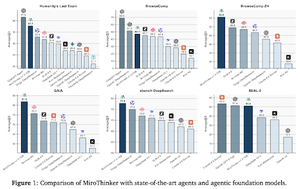

MiroThinker: Расширение границ производительности открытых исследовательских агентов через модель, контекст и интерактивное масштабирование

Статья представляет исследовательского агента, который улучшает производительность по 3 измерениям: размер модели, длина контекста и глубина взаимодействия.

Чтобы поддерживать глубокие процессы рассуждения, модель оснащена контекстным окном 256K и до 600 вызовов инструментов на задачу.

MiroThinker v1.0, оснащенный простым агентом ReAct, достигает SOTA производительности среди исследовательских агентов с открытым исходным кодом.

Что нужно, чтобы стать хорошим агентом по исследованию ИИ? Изучение роли разнообразия идей

В этой статье предлагаются методы количественной оценки и контроля разнообразия идей агента. Выбор агентной структуры значительно влияет на разнообразие идей.

С помощью контролируемого экспериментального дизайна они устанавливают причинно-следственную связь, показывая, что увеличение разнообразия идей приводит к улучшению результатов в задачах MLE-bench. Они также подтверждают надежность, оценивая с помощью альтернативных метрик производительности.

DR Tulu: Обучение с подкреплением с развивающимися рубриками для глубоких исследований

В этой статье обучается глубокое исследование Tulu (DR Tulu-8B), подготовленное для открытых, долгих задач глубоких исследований.

Для решения задачи верификации в долгосрочных задачах, DR-Tulu дообучается на высококачественных пользовательских данных, а затем обучается с помощью RL с развивающимися рубриками (RLER), в которых рубрики соразвиваются с моделью политики в процессе обучения. Они получают результаты лучше, чем у самых сильных открытых моделей 8-32.

Подписывайтесь на нас @ritualdigest, чтобы узнать больше о всем, что связано с криптовалютой и исследованиями в области ИИ, а также @ritualnet, чтобы узнать больше о том, что строит Ritual.

3,01K

Топ

Рейтинг

Избранное