Temas en tendencia

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Aquí está el Ritual Research Digest de esta semana, un boletín que cubre lo último en el mundo de los LLM y la intersección de Crypto x AI.

Con cientos de artículos publicados semanalmente, mantenerse al día con los últimos es imposible. Hacemos la lectura para que usted no tenga que hacerlo.

Think-at-Hard: Iteraciones selectivas latentes para mejorar modelos de lenguaje de razonamiento

La iteración latente dinámica es difícil: necesita contexto completo, objetivos adaptativos, reutilización de parámetros, pero el acoplamiento de calidad política causa inestabilidad en el entrenamiento.

Este trabajo introduce TaH, un pensamiento latente dinámico que solo itera sobre tokens duros mediante el desarrollo de un arco de modelo especializado y un método de entrenamiento estable, aplicando selectivamente iteraciones latentes.

Ajustado de Qwen3-0,6/1,7B-base, TaH logra un +4% en 5 benchmarks de razonamiento.

P1: Dominar las Olimpiadas de Física con Aprendizaje por Refuerzo

Este trabajo introduce P1, una familia de modelos de razonamiento de la física OSS. Integran tanto la escala en tiempo de entrenamiento como en tiempo de prueba, asegurando una mayor capacidad de razonamiento desplegada de forma adaptativa en la inferencia.

Los modelos P1 se entrenan únicamente a través del entrenamiento posterior en RL en LMs base en un marco RL de múltiples etapas. Para el tiempo de prueba, combinan modelos P1 con el marco de agentes PhysicsMinions.

Su modelo P1-235B-A22B logra la medalla de oro en el IPhO 2025.

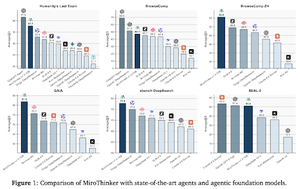

MiroThinker: Empujando los límites del rendimiento de los agentes de investigación de código abierto mediante modelo, contexto y escalado interactivo

El artículo presenta un agente de investigación que impulsa el rendimiento en 3 dimensiones: tamaño del modelo, longitud del contexto y profundidad de interacción.

Para sostener procesos de razonamiento profundos, el modelo está equipado con una ventana de contexto de 256K y hasta 600 llamadas a herramientas por tarea.

MiroThinker v1.0, equipado con un agente ReAct sencillo, logra el rendimiento SOTA entre agentes de investigación de código abierto.

¿Qué se necesita para ser un buen agente de investigación en IA? Estudio del papel de la diversidad de ideaciones

Este artículo propone métodos para cuantificar y controlar la diversidad de ideaciones del agente. La elección del andamiaje agente influye significativamente en la diversidad de ideaciones.

Mediante un diseño experimental controlado, establecen una relación causal, mostrando que el aumento de la diversidad de ideaciones conduce a un mejor rendimiento en tareas de laboratorio MLE. También establecen robustez cuando se evalúan con métricas de rendimiento alternativas.

DR Tulu: Aprendizaje por refuerzo con rúbricas evolutivas para investigación profunda

Este artículo forma a Tulu de investigación profunda (DR Tulu-8B) entrenados para tareas de investigación profunda abiertas y de larga duración.

Para abordar la verificación en tareas de formato largo, DR-Tulu se ajusta con datos de usuario de alta calidad y luego se entrena mediante RL con rúbricas evolutivas (RLER), en las que las rúbricas coevolucionan con el modelo de políticas durante la formación. Obtienen mejores resultados que los modelos abiertos 8-32 más potentes.

Síganos @ritualdigest para obtener más información sobre todo lo relacionado con la investigación de cripto x IA, y

@ritualnet para obtener más información sobre lo que Ritual está construyendo.

3K

Populares

Ranking

Favoritas