Актуальні теми

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Ось Ritual Research Digest цього тижня, інформаційний бюлетень, який висвітлює найновіші новини у світі LLM та перетин Crypto x AI.

З сотнями газет, що публікуються щотижня, залишатися в курсі останніх неможливо. Ми читаємо, щоб вам не доводилося цього робити.

Think-at-hard: вибіркові латентні ітерації для покращення моделей мови мислення

Динамічна латентна ітерація складна: їй потрібен повний контекст, адаптивні цілі, повторне використання параметрів, але зв'язок якості політики спричиняє нестабільність навчання.

Ця робота вводить TaH — динамічне латентне мислення, яке ітерує лише над твердими токенами, розробляючи спеціалізовану арку моделі та стабільний метод навчання, вибірково застосовуючи латентну ітерацію.

Відточена від Qwen3-0.6/1.7B-Base, TaH досягає +4% за 5 бенчмарками логіки.

P1: Опанування олімпіад з фізики з підкріпленням навчання

Ця робота вводить P1 — сімейство моделей фізичного мислення OSS. Вони інтегрують як масштабування часу навчання, так і часу тестування, забезпечуючи більш потужну здатність мислення, адаптивно розгорнуту на висновку.

Моделі P1 навчаються виключно через RL після навчання на базових LM у багатоступеневій RL-системі. Для тестування вони поєднують моделі P1 з фреймворком агентів PhysicsMinions.

Їхня модель P1-235B-A22B досягла золотих результатів на IPhO 2025.

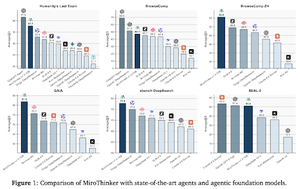

MiroThinker: Розширення меж продуктивності відкритих дослідницьких агентів через модель, контекст і інтерактивне масштабування

У статті представлено дослідницький агент, який підвищує продуктивність за трьома вимірами: розмір моделі, довжину контексту та глибину взаємодії.

Для підтримки процесів глибокого мислення модель оснащена контекстним вікном 256K і до 600 викликів інструментів на завдання.

MiroThinker v1.0, оснащений простим агентом ReAct, забезпечує SOTA-продуктивність серед відкритих дослідницьких агентів.

Що потрібно, щоб стати хорошим агентом з досліджень у сфері ШІ? Вивчення ролі різноманіття ідей

У цій статті пропонуються методи кількісної оцінки та контролю різноманітності ідей агента. Вибір агентного каркасу суттєво впливає на різноманітність ідей.

За допомогою контрольованого експериментального дизайну вони встановлюють причинно-наслідковий зв'язок, показуючи, що збільшення різноманіття ідей веде до покращення результатів у MLE-лабораторних завданнях. Вони також встановлюють стійкість при оцінці за альтернативними показниками ефективності.

DR Tulu: Підкріплене навчання з еволюційними рубриками для глибоких досліджень

Ця стаття навчає глибоких дослідників тулу (DR Tulu-8B), які тренуються до відкритих, довгих завдань глибоких досліджень.

Для вирішення верифікації у довготривалих завданнях DR-Tulu доопрацьовується на високоякісних даних користувачів, а потім навчається через RL з еволюційними рубриками (RLER), у яких рубрики співпрацюють із політичною моделлю під час навчання. Вони отримують кращі результати, ніж найміцніші відкриті моделі 8-32.

Слідкуйте за нами @ritualdigest, щоб дізнатися більше про все, що стосується досліджень crypto x AI, а також

@ritualnet дізнатися більше про те, що будує Ritual.

3K

Найкращі

Рейтинг

Вибране