Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Voici le Digest de Recherche Rituel de cette semaine, une newsletter couvrant les dernières nouvelles dans le monde des LLM et l'intersection entre Crypto et AI.

Avec des centaines d'articles publiés chaque semaine, il est impossible de rester à jour avec les dernières informations. Nous faisons la lecture pour que vous n'ayez pas à le faire.

Think-at-Hard : Itérations latentes sélectives pour améliorer les modèles de langage de raisonnement

L'itération latente dynamique est difficile : elle nécessite un contexte complet, des objectifs adaptatifs, une réutilisation des paramètres, mais le couplage de qualité de politique entraîne une instabilité de l'entraînement.

Ce travail introduit TaH, une pensée latente dynamique qui itère uniquement sur des tokens difficiles en développant une architecture de modèle spécialisée et une méthode d'entraînement stable, appliquant sélectivement l'itération latente.

Affinée à partir de Qwen3-0.6/1.7B-Base, TaH atteint +4 % sur 5 benchmarks de raisonnement.

P1 : Maîtriser les Olympiades de Physique avec l'Apprentissage par Renforcement

Ce travail présente P1, une famille de modèles de raisonnement en physique OSS. Ils intègrent à la fois l'échelle d'entraînement et l'échelle de test, garantissant une capacité de raisonnement plus forte déployée de manière adaptative lors de l'inférence.

Les modèles P1 sont entraînés uniquement par RL après l'entraînement sur des LMs de base dans un cadre RL multi-étapes. Pour le temps de test, ils combinent les modèles P1 avec le cadre d'agents PhysicsMinions.

Leur modèle P1-235B-A22B atteint des performances de médaille d'or lors de l'IPhO 2025.

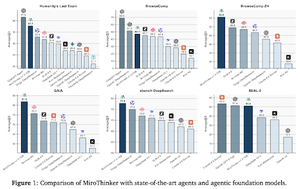

MiroThinker : Pousser les limites de performance des agents de recherche open-source via la taille du modèle, la longueur du contexte et l'échelle interactive

L'article présente un agent de recherche qui améliore la performance sur 3 dimensions : la taille du modèle, la longueur du contexte et la profondeur d'interaction.

Pour soutenir des processus de raisonnement approfondis, le modèle est équipé d'une fenêtre de contexte de 256K et jusqu'à 600 appels d'outils par tâche.

MiroThinker v1.0, équipé d'un agent ReAct simple, atteint des performances SOTA parmi les agents de recherche open-source.

Qu'est-ce qu'il faut pour être un bon agent de recherche en IA ? Étudier le rôle de la diversité des idées

Cet article propose des méthodes pour quantifier et contrôler la diversité des idées de l'agent. Le choix de l'échafaudage agentique influence considérablement la diversité des idées.

Grâce à un design expérimental contrôlé, ils établissent une relation causale, montrant que l'augmentation de la diversité des idées conduit à une amélioration des performances sur les tâches MLE-bench. Ils établissent également la robustesse lorsqu'ils sont évalués avec des métriques de performance alternatives.

DR Tulu : Apprentissage par renforcement avec des rubriques évolutives pour la recherche approfondie

Cet article forme la recherche approfondie Tulu (DR Tulu-8B) entraînée pour des tâches de recherche approfondie ouvertes et de longue durée.

Pour aborder la vérification dans des tâches longues, DR-Tulu est affiné sur des données utilisateur de haute qualité, puis entraîné via RL avec des rubriques évolutives (RLER), dans lesquelles les rubriques coévoluent avec le modèle de politique pendant l'entraînement. Ils obtiennent des résultats meilleurs que les modèles ouverts les plus puissants 8-32.

Suivez-nous @ritualdigest pour en savoir plus sur tout ce qui concerne la crypto et la recherche en IA, et @ritualnet pour en apprendre davantage sur ce que Ritual est en train de construire.

3K

Meilleurs

Classement

Favoris