Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Hier ist der Ritual Research Digest dieser Woche, ein Newsletter, der die neuesten Entwicklungen in der Welt der LLMs und der Schnittstelle von Crypto x AI abdeckt.

Mit Hunderten von wöchentlich veröffentlichten Arbeiten ist es unmöglich, auf dem neuesten Stand zu bleiben. Wir lesen für Sie, damit Sie es nicht müssen.

Think-at-Hard: Selektive latente Iterationen zur Verbesserung von Sprachmodellen für das logische Denken

Dynamische latente Iteration ist schwierig: Sie benötigt den vollständigen Kontext, adaptive Ziele, Parameterwiederverwendung, aber die Kopplung der Politikqualität verursacht Trainingsinstabilität.

Diese Arbeit führt TaH ein, dynamisches latentes Denken, das nur über harte Tokens iteriert, indem ein spezialisiertes Modellarchitektur und eine stabile Trainingsmethode entwickelt werden, die latente Iteration selektiv anwendet.

Feinabgestimmt von Qwen3-0.6/1.7B-Base erreicht TaH +4% über 5 Denkbenchmarks.

P1: Physik-Olympiaden mit Reinforcement Learning meistern

Diese Arbeit stellt P1 vor, eine Familie von OSS-Physik-Reasoning-Modellen. Sie integrieren sowohl Skalierung zur Trainingszeit als auch zur Testzeit und gewährleisten eine stärkere reasoning-Fähigkeit, die adaptiv bei der Inferenz eingesetzt wird.

P1-Modelle werden rein durch RL nach dem Training auf Basis-LMs in einem mehrstufigen RL-Rahmen trainiert. Für die Testzeit kombinieren sie P1-Modelle mit dem PhysicsMinions-Agentenrahmen.

Ihr Modell P1-235B-A22B erzielt eine Goldmedaille-Leistung bei der IPhO 2025.

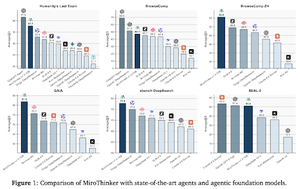

MiroThinker: Die Leistungsgrenzen von Open-Source-Forschungsagenten durch Modell, Kontext und interaktive Skalierung erweitern

Das Papier stellt einen Forschungsagenten vor, der die Leistung in 3 Dimensionen steigert: Modellgröße, Kontextlänge und Interaktionstiefe.

Um tiefgreifende Denkprozesse aufrechtzuerhalten, ist das Modell mit einem 256K Kontextfenster und bis zu 600 Toolaufrufen pro Aufgabe ausgestattet.

MiroThinker v1.0, ausgestattet mit einem einfachen ReAct-Agenten, erreicht eine SOTA-Leistung unter Open-Source-Forschungsagenten.

Was braucht es, um ein guter AI-Forschungsagent zu sein? Die Rolle der Ideenvielfalt untersuchen

Dieses Papier schlägt Methoden vor, um die Ideenvielfalt des Agenten zu quantifizieren und zu steuern. Die Wahl des agentischen Gerüsts beeinflusst die Ideenvielfalt erheblich.

Durch ein kontrolliertes experimentelles Design stellen sie eine kausale Beziehung her, die zeigt, dass eine erhöhte Ideenvielfalt zu einer verbesserten Leistung bei MLE-bench-Aufgaben führt. Sie stellen auch die Robustheit fest, wenn sie mit alternativen Leistungsmetriken bewertet werden.

DR Tulu: Verstärkendes Lernen mit sich entwickelnden Rubriken für tiefgehende Forschung

Dieses Papier trainiert die tiefgehende Forschung Tulu (DR Tulu-8B), die für offene, langfristige tiefgehende Forschungsaufgaben trainiert wurde.

Um die Verifizierung bei langfristigen Aufgaben zu adressieren, wird DR-Tulu auf hochwertigen Benutzerdaten feinabgestimmt und dann über RL mit sich entwickelnden Rubriken (RLER) trainiert, bei denen die Rubriken während des Trainings mit dem Politikmodell ko-evolvieren. Sie erzielen Ergebnisse, die besser sind als die stärksten offenen 8-32 Modelle.

Folge uns @ritualdigest für mehr über alles, was mit Krypto x AI-Forschung zu tun hat, und @ritualnet, um mehr darüber zu erfahren, was Ritual aufbaut.

3K

Top

Ranking

Favoriten