トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

今週の Ritual Research Digest は、LLM の世界の最新情報と Crypto x AI の交差点をカバーするニュースレターです。

毎週何百もの論文が発行されているため、最新の情報を入手することは不可能です。私たちはあなたがその必要を省くように読書を行います。

Think-at-Hard:推論言語モデルを改善する選択的潜在反復

動的潜在反復は難しく、完全なコンテキスト、適応目標、パラメータの再利用が必要ですが、ポリシー品質の結合はトレーニングの不安定性を引き起こします。

この研究では、TaH(動的潜在思考)を導入し、専門的なモデルアーチと安定した訓練手法を開発し、選択的に潜在反復を適用します。

Qwen3-0.6/1.7B-ベースから微調整されたTaHは、5つの推論ベンチマークで+4%の達成を達成しています。

P1:強化学習による物理オリンピアードの習得

本研究では、OSS物理推論モデルのファミリーであるP1を紹介します。これらはトレインタイムとテストタイムのスケーリングの両方を統合し、推論時に適応的に展開する強力な推論能力を保証します。

P1モデルは、多段階の強化学習フレームワークの基礎LM上で純粋に強化学習(RL)によるポストトレーニングで訓練されます。テスト時間のために、P1モデルとPhysicsMinionsエージェントフレームワークを組み合わせています。

彼らのモデルP1-235B-A22Bは、iPhone 2025でゴールドメダルを獲得しました。

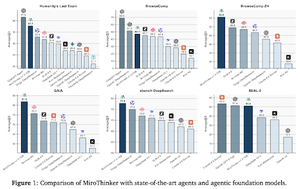

MiroThinker:モデル、コンテキスト、インタラクティブスケーリングを通じたオープンソース研究エージェントのパフォーマンス境界を押し広げる

この論文は、モデルサイズ、コンテキストの長さ、相互作用の深さという3次元でパフォーマンスを推し進める研究エージェントを紹介しています。

深い推論プロセスを維持するために、モデルには256Kのコンテキストウィンドウと1タスクあたり最大600のツール呼び出しが搭載されています。

MiroThinker v1.0はシンプルなReActエージェントを搭載し、オープンソースの研究エージェントの中でSOTA性能を達成しています。

優れたAI研究エージェントになるには何が必要でしょうか?アイデアの多様性の役割の研究

本論文は、エージェントのアイデアの多様性を定量化し制御する方法を提案します。エージェントスキャフォールドの選択は、アイデアの多様性に大きな影響を与えます。

管理された実験デザインを通じて、彼らは因果関係を確立し、アイデアの多様性を高めることがMLEベンチタスクのパフォーマンス向上につながることを示しました。また、代替的なパフォーマンス指標と組み合わせて評価することで堅牢性が確立されます。

DR Tulu:進化するルーブリックを用いた深層研究のための強化学習

本論文は、オープンエンドで長期の深層研究タスク向けに訓練されたトゥル(DR Tulu-8B)を訓練しています。

長尺タスクでの検証に対応するため、DR-Tuluは高品質なユーザーデータに基づいて微調整され、その後RLで進化ルーブリック(RLER)を用いて訓練されます。RLERでは、ルーブリックがトレーニング中にポリシーモデルと共進化します。これらは最も強力なオープン8-32モデルよりも良い結果を得ています。

暗号通貨 x AI 研究に関するすべての詳細については、@ritualdigest をフォローしてください。

@ritualnet Ritualが構築しているものについて詳しく知りたい。

3K

トップ

ランキング

お気に入り