Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Oto najnowszy Digest Ritual Research, newsletter obejmujący najnowsze wydarzenia w świecie LLM-ów oraz na styku Crypto x AI.

Z setkami publikacji co tydzień, niemożliwe jest nadążanie za nowinkami. My czytamy, abyś nie musiał.

Think-at-Hard: Selektywne iteracje latentne w celu poprawy modeli językowych rozumowania

Dynamiczna iteracja latentna jest trudna: wymaga pełnego kontekstu, adaptacyjnych celów, ponownego wykorzystania parametrów, ale sprzężenie jakości polityki powoduje niestabilność treningu.

Ta praca wprowadza TaH, dynamiczne myślenie latentne, które iteruje tylko po twardych tokenach, rozwijając specjalizowaną architekturę modelu i stabilną metodę treningową, selektywnie stosując iterację latentną.

Dostosowany z Qwen3-0.6/1.7B-Base, TaH osiąga +4% w 5 benchmarkach rozumowania.

P1: Opanowanie Olimpiad Fizycznych z wykorzystaniem Uczenia przez Wzmocnienie

Niniejsza praca wprowadza P1, rodzinę modeli OSS do rozumowania fizycznego. Integrują one zarówno skalowanie w czasie treningu, jak i w czasie testu, zapewniając silniejszą zdolność rozumowania wdrażaną adaptacyjnie podczas wnioskowania.

Modele P1 są trenowane wyłącznie za pomocą RL po treningu na podstawowych LM w wieloetapowym frameworku RL. Na czas testów łączą modele P1 z frameworkiem agenta PhysicsMinions.

Ich model P1-235B-A22B osiąga złoty medal w IPhO 2025.

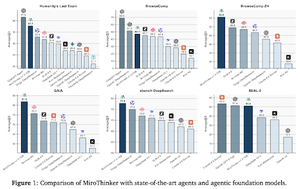

MiroThinker: Przekraczanie granic wydajności otwartych agentów badawczych poprzez model, kontekst i interaktywne skalowanie

Artykuł wprowadza agenta badawczego, który zwiększa wydajność w 3 wymiarach: rozmiar modelu, długość kontekstu i głębokość interakcji.

Aby utrzymać głębokie procesy rozumowania, model jest wyposażony w okno kontekstowe 256K i do 600 wywołań narzędzi na zadanie.

MiroThinker v1.0, wyposażony w prostego agenta ReAct, osiąga najlepsze wyniki wśród agentów badawczych open-source.

Co jest potrzebne, aby być dobrym agentem badawczym AI? Badanie roli różnorodności ideacji

Niniejszy artykuł proponuje metody kwantyfikacji i kontrolowania różnorodności ideacji agenta. Wybór struktury agentowej ma znaczący wpływ na różnorodność ideacji.

Poprzez kontrolowany projekt eksperymentalny ustalają związek przyczynowy, pokazując, że zwiększenie różnorodności idei prowadzi do poprawy wyników w zadaniach MLE-bench. Ustalają również odporność, gdy są oceniani za pomocą alternatywnych metryk wydajności.

DR Tulu: Uczenie przez wzmocnienie z ewoluującymi rubrykami dla głębokich badań

Niniejszy artykuł szkoli głębokie badania Tulu (DR Tulu-8B) przeszkolone do otwartych, długoterminowych zadań badawczych.

Aby zająć się weryfikacją w zadaniach długoterminowych, DR-Tulu jest dostosowywane na podstawie wysokiej jakości danych użytkowników, a następnie trenowane za pomocą RL z ewoluującymi rubrykami (RLER), w których rubryki współewoluują z modelem polityki podczas treningu. Osiągają wyniki lepsze niż najsilniejsze otwarte modele 8-32.

Śledź nas @ritualdigest, aby uzyskać więcej informacji na temat wszystkiego, co związane z kryptowalutami i badaniami AI, oraz @ritualnet, aby dowiedzieć się więcej o tym, co buduje Ritual.

3K

Najlepsze

Ranking

Ulubione