Populære emner

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Her er denne ukens Ritual Research Digest, et nyhetsbrev som dekker det siste i verden av LLM-er og skjæringspunktet mellom Crypto x AI.

Med hundrevis av artikler utgitt ukentlig, er det umulig å holde seg oppdatert med det siste. Vi leser slik at du ikke trenger å gjøre det.

Think-at-Hard: Selektive latente iterasjoner for å forbedre resonnementsspråkmodeller

Dynamisk latent iterasjon er vanskelig: det krever full kontekst, adaptive mål, gjenbruk av parametere, men kobling mellom policy-kvalitet og politikk fører til treningsustabilitet.

Dette arbeidet introduserer TaH, dynamisk latent tenkning som kun iterererer over harde tokens ved å utvikle en spesialisert modellbue og en stabil treningsmetode, med selektiv bruk av latent iterasjon.

Finjustert fra Qwen3-0,6/1,7B-Base oppnår TaH +4 % over 5 resonnement-benchmarks.

P1: Å mestre fysikkolympiader med forsterkningslæring

Dette arbeidet introduserer P1, en familie av OSS-fysikkbaserte resonnementsmodeller. De integrerer både skalering av togtid og testtid, noe som sikrer sterkere resonnementsevne som brukes adaptivt ved inferens.

P1-modellene trenes utelukkende gjennom RL etter trening på basis-LM-er i et flertrinns RL-rammeverk. For testtid kombinerer de P1-modeller med PhysicsMinions-agentrammeverket.

Deres modell P1-235B-A22B oppnår gullmedalje-ytelse på IPhO 2025.

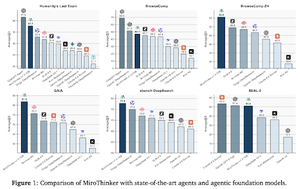

MiroThinker: Å presse ytelsesgrensene for åpen kildekode-forskningsagenter via modell-, kontekst- og interaktiv skalering

Artikkelen introduserer et forskningsobjekt som presser ytelse på tre dimensjoner: modellstørrelse, kontekstlengde og interaksjonsdybde.

For å opprettholde dype resonneringsprosesser er modellen utstyrt med et kontekstvindu på 256K og opptil 600 verktøykall per oppgave.

MiroThinker v1.0, utstyrt med en enkel ReAct-agent, oppnår SOTA-ytelse blant åpen kildekode-forskningsagenter.

Hva kreves for å være en god AI-forskningsagent? Studiet av ideermangfoldets rolle

Denne artikkelen foreslår metoder for å kvantifisere og kontrollere agentens idealitetsmangfold. Valget av agentisk stillas har stor innvirkning på ideutviklingsmangfoldet.

Gjennom et kontrollert eksperimentelt design etablerer de en årsakssammenheng, og viser at økt idémangfold fører til bedre ytelse på MLE-benkoppgaver. De etablerer også robusthet når de evalueres med alternative ytelsesmålinger.

DR Tulu: Forsterkningslæring med utviklende vurderingskriterier for dyp forskning

Denne artikkelen trener dypforsknings Tulu (DR Tulu-8B) trent for åpne, langsiktige, dype forskningsoppgaver.

For å håndtere verifisering i langformede oppgaver, finjusteres DR-Tulu på høykvalitets brukerdata, og trenes deretter via RL med utviklende rubrikker (RLER), der rubrikkene samevolveres med policymodellen under opplæringen. De oppnår resultater bedre enn de sterkeste åpne 8-32-modellene.

Følg oss @ritualdigest for mer om alt som har med krypto x AI-forskning å gjøre, og

@ritualnet lære mer om hva Ritual bygger.

3K

Topp

Rangering

Favoritter