熱門話題

#

Bonk 生態迷因幣展現強韌勢頭

#

有消息稱 Pump.fun 計劃 40 億估值發幣,引發市場猜測

#

Solana 新代幣發射平臺 Boop.Fun 風頭正勁

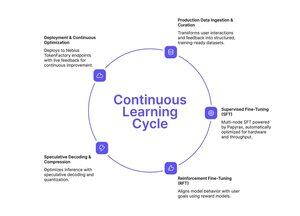

如果你一直在關注 Tinker 的簡化微調方法,Nebius Token Factory 剛剛推出了類似的產品 - 但專為生產規模而建。

在 Nebius Token Factory 上進行後訓練可以讓你在多節點集群中微調前沿 LLM(DeepSeek V3、GPT-OSS 120B、Qwen3 Coder 480B),並立即將其部署到企業級端點。

- 支持高達 480B 參數的完整 SFT + LoRA FT

- 無需基礎設施設置的多節點訓練(8-512 GPUs)

- 長上下文穩定性高達 131k 令牌

- 從實時日誌中進行生產數據攝取

- 一鍵部署,附帶 SLA 和零保留隱私

完整的流程:訓練、優化、部署和服務 - 所有這些都在一個平台上。

如果你需要能夠實際擴展到生產流量的自定義模型,並且具有可預測的延遲和數據隱私,這是值得探索的。

1/2

熱門

排行

收藏