Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

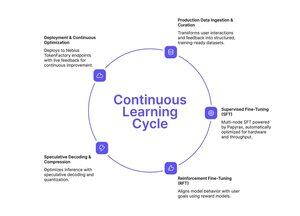

Jeśli śledziłeś podejście Tinkera do uproszczonego fine-tuningu, Nebius Token Factory właśnie uruchomił coś podobnego - ale zbudowanego na skalę produkcyjną.

Post-trening w Nebius Token Factory pozwala na fine-tuning nowoczesnych LLM (DeepSeek V3, GPT-OSS 120B, Qwen3 Coder 480B) w klastrach wielowęzłowych i natychmiastowe wdrażanie ich na punktach końcowych klasy enterprise.

- Pełny SFT + LoRA FT dla modeli do 480B parametrów

- Trening wielowęzłowy (8-512 GPU) bez konfiguracji infrastruktury

- Stabilność długiego kontekstu do 131k tokenów

- Wchłanianie danych produkcyjnych z aktywnych logów

- Wdrażanie jednym kliknięciem z SLA i prywatnością bez retencji

Pełny proces: trening, optymalizacja, wdrażanie i serwowanie - wszystko na jednej platformie.

Jeśli potrzebujesz niestandardowych modeli, które rzeczywiście skalują się do ruchu produkcyjnego z przewidywalną latencją i prywatnością danych, warto to zbadać.

1/2

Najlepsze

Ranking

Ulubione