Populaire onderwerpen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

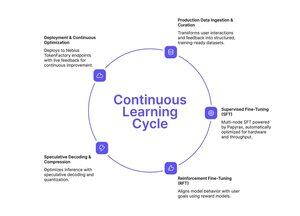

Als je de aanpak van Tinker voor vereenvoudigde fine-tuning hebt gevolgd, heeft Nebius Token Factory net iets vergelijkbaars gelanceerd - maar gebouwd voor productie-schaal.

Post-training op Nebius Token Factory stelt je in staat om frontier LLM's (DeepSeek V3, GPT-OSS 120B, Qwen3 Coder 480B) te fine-tunen over multi-node clusters en ze onmiddellijk te implementeren op enterprise-grade eindpunten.

- Volledige SFT + LoRA FT voor modellen tot 480B parameters

- Multi-node training (8-512 GPU's) zonder infrastructuursetup

- Stabiliteit bij lange context tot 131k tokens

- Productiegegevensinname vanuit live logs

- One-click implementatie met SLA's en privacy zonder opslag

De volledige pijplijn: training, optimalisatie, implementatie en service - alles op één platform.

Als je aangepaste modellen nodig hebt die daadwerkelijk opschalen naar productieverkeer met voorspelbare latentie en gegevensprivacy, is dit het waard om te verkennen.

1/2

Boven

Positie

Favorieten