Актуальные темы

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

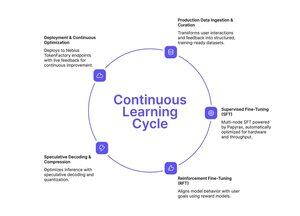

Если вы следили за подходом Tinker's к упрощенному тонкому обучению, Nebius Token Factory только что запустила нечто подобное - но созданное для производственного масштаба.

Постобучение на Nebius Token Factory позволяет вам тонко настраивать передовые LLM (DeepSeek V3, GPT-OSS 120B, Qwen3 Coder 480B) на многонодовых кластерах и мгновенно развертывать их на конечных точках корпоративного уровня.

- Полное SFT + LoRA FT для моделей до 480B параметров

- Многонодовое обучение (8-512 GPU) без настройки инфраструктуры

- Стабильность длинного контекста до 131k токенов

- Поглощение производственных данных из живых логов

- Развертывание в один клик с SLA и нулевой приватностью хранения

Полный процесс: обучение, оптимизация, развертывание и обслуживание - все на одной платформе.

Если вам нужны кастомные модели, которые действительно масштабируются под производственный трафик с предсказуемой задержкой и конфиденциальностью данных, это стоит изучить.

1/2

Топ

Рейтинг

Избранное