熱門話題

#

Bonk 生態迷因幣展現強韌勢頭

#

有消息稱 Pump.fun 計劃 40 億估值發幣,引發市場猜測

#

Solana 新代幣發射平臺 Boop.Fun 風頭正勁

雙重下降顯示盧卡斯批評僅適用於局部。

也就是說,模型誤差隨著參數的增加而上升到某個點("過擬合"),但隨著參數的增加又會下降。

經濟學簡化模型以適應所謂的樣本外擬合是個錯誤——只需繼續前進!

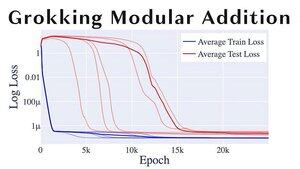

另一個有趣的機器學習主題是「grokking」,在這個過程中,模型會突然從過擬合轉變為泛化。

如果你是 @alz_zyd_,我想你會說這是模型開始成為一個思考的存在並開始理解的跡象。

108.71K

熱門

排行

收藏