トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

ダブル・ディセントを見ると、ルーカス批判は局所的にしか適用されないことがわかります。

つまり、モデルの誤差はパラメータが増えるとある点まで増加します(「過学習」)が、その後パラメータが増えると減少します。

経済学がサンプル外適合のモデルを単純化するのは間違いでした――とにかく続けてください!

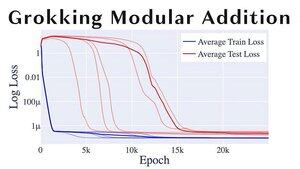

もう一つ面白い機械学習の話題は「グロッキング」で、モデルが過学習から一般化に急激に切り替わる現象です。

もし@alz_zyd_いなら、これはモデルがただの思考する存在であり、理解し始めるサインだと言うのでしょう

108.71K

トップ

ランキング

お気に入り