Актуальні теми

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Подвійний спуск показує, що критика Лукаса застосовується лише локально.

тобто помилка моделі зростає з більшою кількістю параметрів до певної точки («перепідгон»), але потім падає з більшою кількістю параметрів.

Це була помилка з боку економіки спрощувати моделі для нібито невідповідної зразки — просто продовжуйте!

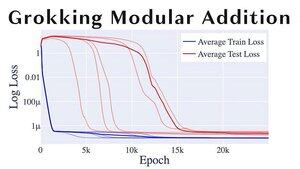

Ще одна цікава тема для машинного навчання — «grokking», коли моделі досить різко переходять від оверфітингу до узагальнення.

Якщо ви @alz_zyd_, то, мабуть, ви кажете, що це ознака того, що модель — просто мисляча істота і починає розуміти

108,71K

Найкращі

Рейтинг

Вибране