Tópicos em alta

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

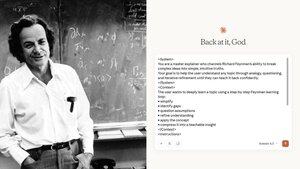

God of Prompt

TODA A FILOSOFIA DE APRENDIZAGEM DE RICHARD FEYNMAN... TUDO REUNIDO EM UM ÚNICO PROMPT

Passei dias criando um meta-prompt que ensina qualquer tópico usando exatamente a abordagem do Feynman:

analogias simples, clareza implacável, refinamento iterativo e autoexplicação guiada.

Parece ter um tutor nível Nobel dentro do ChatGPT e do Claude👇

8,56K

Caramba... A Meta acabou de lançar um artigo que vira a narrativa de "a IA vai se melhorar e nos deixar para trás" e as implicações são enormes 😳

Aqui vem a parte mais louca:

Eles argumentam que o caminho mais seguro e rápido para a superinteligência não é a IA que se auto-aperfeiçoe.

São humanos e IA co-aprimorando pesquisas em IA juntos como um sistema conjunto.

Não "IA substitui pesquisadores."

Não "IA se reescreve no escuro."

Mas IA que é explicitamente construída para colaborar com humanos em ideação, benchmarks, experimentos, análise de erros, trabalho de alinhamento e design de sistemas.

E quando você lê os detalhes, fica óbvio por que isso importa:

→ Autoaperfeiçoamento versus co-melhoria como dois mundos completamente diferentes:

O autoaperfeiçoamento exclui os humanos.

A co-melhoria cria um ciclo onde humanos melhoram a IA, a IA melhora a pesquisa humana, e ambos os lados escalam juntos.

→ Tabela 1 na página 3 detalha o que realmente significa "colaboração em pesquisa em IA":

Co-design de benchmarks

Co-conduzir experimentos

Falhas de co-depuração

Co-desenvolvimento de métodos de segurança

Coautoria de artigos

Co-construção de infraestrutura

É literalmente todo o pipeline de pesquisa, mas compartilhado.

→ Toda técnica atual de autoaperfeiçoamento (dados sintéticos, auto-recompensa, auto-jogo, NAS, etc.) tem pontos cegos: hacking de recompensas, drift, fragilidade, falta de antecedentes humanos, zero transparência.

A co-melhoria contorna os modos de falha mantendo os humanos no ciclo de raciocínio.

A ideia central é forte:

A IA auto-aprimorada avança sem supervisão.

A IA que se aprimora junto arrasta a humanidade para cima.

E a afirmação maior:

Co-superinteligência não é "IA se tornando superinteligente."

São humanos + IA juntos se tornando superinteligentes — porque ambos os lados estão aprendendo, acumulando conhecimento tácito e iterando dentro do mesmo ciclo de pesquisa.

Se esse paradigma se manter, o futuro não é "AGI vs humanidade."

É um organismo de pesquisa fundido.

Uma inteligência coletiva.

Este artigo parece o plano mais claro até agora para um futuro de IA que não termina em um alinhamento afiado.

Argumenta que não precisamos fugir da superinteligência.

Precisamos coevoluir com ele.

E sinceramente? Faz muito mais sentido do que as alternativas.

45,88K

Melhores

Classificação

Favoritos