Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Google Research vient de dévoiler deux avancées dans le modélisation de séquences :

🔹Titans, une architecture de mémoire neuronale profonde

🔹MIRAS, un cadre unificateur pour la mémoire AI à long terme.

Titans apprend et met à jour la mémoire en temps réel en utilisant une "métrique de surprise" pour capturer uniquement les informations nouvelles les plus importantes.

MIRAS fournit le plan : optimisation en temps réel, dégradation de la mémoire et fonctions de perte non-euclidiennes qui surpassent les Transformers et Mamba sur des tâches ultra-longues s'étendant à plus de 2M de tokens.

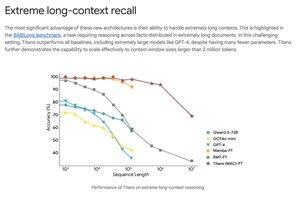

Titans surpasse GPT-4 sur des benchmarks de contexte extrême comme BABILong en utilisant beaucoup moins de paramètres.

Meilleurs

Classement

Favoris