Trendaavat aiheet

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Google Research julkaisi juuri kaksi läpimurtoa sekvenssimallinnuksessa:

🔹Titans, syvä hermomuistiarkkitehtuuri

🔹MIRAS, yhdistävä kehys pitkäaikaiselle tekoälymuistille.

Titans oppii ja päivittää muistinsa lennossa käyttäen "yllätysmittaria" kerätäkseen vain tärkeimmät uudet tiedot.

MIRAS tarjoaa suunnitelman: reaaliaikainen optimointi, muistin heikkeneminen ja ei-euklidiset häviöfunktiot, jotka päihittävät Transformersin ja Mamban erittäin pitkissä tehtävissä, jotka skaalautuvat 2M+-tokeneihin.

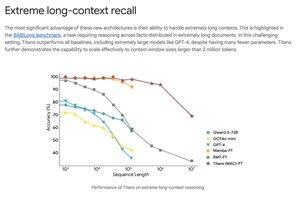

Titans voittaa GPT-4:n äärimmäisissä pitkän kontekstin testeissä, kuten BABILongissa, käyttäen paljon vähemmän parametreja.

Johtavat

Rankkaus

Suosikit