Populaire onderwerpen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Google Research heeft zojuist twee doorbraken in sequentiemodellering gepresenteerd:

🔹Titans, een diep neurale geheugenarchitectuur

🔹MIRAS, een verenigend kader voor langetermijn AI-geheugen.

Titans leert en werkt geheugen on-the-fly bij met behulp van een "verrassingsmaatstaf" om alleen de belangrijkste nieuwe informatie vast te leggen.

MIRAS biedt het blauwdruk: realtime optimalisatie, geheugenverval en niet-Euclidische verliesfuncties die beter presteren dan Transformers en Mamba op ultra-lange taken die schalen tot 2M+ tokens.

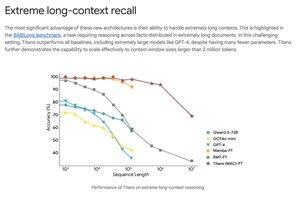

Titans verslaat GPT-4 op extreme lange-context benchmarks zoals BABILong met veel minder parameters.

Boven

Positie

Favorieten