Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Google Research hat gerade zwei Durchbrüche im Bereich der Sequenzmodellierung vorgestellt:

🔹Titans, eine tiefe neuronale Speicherarchitektur

🔹MIRAS, ein einheitliches Framework für langfristigen KI-Speicher.

Titans lernt und aktualisiert den Speicher in Echtzeit mithilfe einer „Überraschungsmetrik“, um nur die wichtigsten neuen Informationen zu erfassen.

MIRAS bietet den Plan: Echtzeit-Optimierung, Speicherverfall und nicht-euklidische Verlustfunktionen, die Transformers und Mamba bei ultra-langen Aufgaben mit über 2 Millionen Tokens übertreffen.

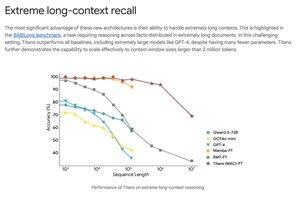

Titans schlägt GPT-4 bei extremen Langzeit-Kontext-Benchmarks wie BABILong mit deutlich weniger Parametern.

Top

Ranking

Favoriten