Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

EigenPhi HQ 🎯 Wisdom of DeFi (🔭, 🎙) 🦇🔊

Enterprise-AI-Anwendungsfälle sind Bereiche, in denen die Verifizierung oft kompliziert wird. Aber wenn Sie strukturierte Protokolle, wirtschaftliche Absichten oder das Verhalten von Agenten nutzen können, können Sie das Signal verstärken. Lassen Sie uns zusammenarbeiten, um diese verifizierbaren Verhaltensweisen in die Modelltrainingsregime zu integrieren.

Salesforce AI Research24. Sept., 08:57

📣 Variation in Verification: Verständnis der Verifizierungsdynamik in großen Sprachmodellen

📄 Papier:

🔗 Projekt:

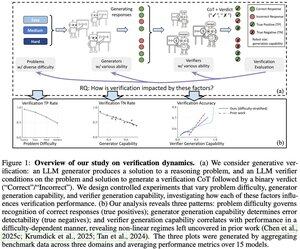

Haben Sie sich jemals gefragt, ob Ihr LLM-Verifizierer tatsächlich zuverlässig für Ihre Aufgabe ist? Unser Analyse-Framework zeigt drei Schlüsselfaktoren, die den Verifizierungserfolg über die Problemschwierigkeit, die Fähigkeit des Generators und die Fähigkeit des Verifizierers bestimmen.

Wichtige Erkenntnisse:

📈 Die Problematik treibt die Erkennung korrekter Antworten - Verifizierer sind bei einfachen Problemen hervorragend, haben aber Schwierigkeiten mit schwierigen.

🔍 Die Stärke des Generators beeinflusst die Fehlererkennung - schwache Generatoren produzieren offensichtliche Fehler, starke schaffen elegante, aber falsche Lösungen.

⚖️ Die Skalierung des Verifizierers zeigt abnehmende Erträge in bestimmten Regimen - manchmal schlägt GPT-4o gerade so kleinere Modelle.

💡 Für die Testzeit-Skalierung: schwache Generatoren + Verifizierung können die Leistung starker Generatoren erreichen, und teure Verifizierer sind nicht immer lohnenswert.

Großartige Arbeit von Yefan Zhou @LiamZhou98, Austin Xu @austinsxu, Yilun Zhou @YilunZhou, Janvijay Singh @iamjanvijay, Jiang Gui @JiangGui, Shafiq Joty @JotyShafiq!

#LLM #AIVerification #TestTimeScaling #FutureOfAI #EnterpriseAI

745

Kudos an das TOOL-Team 👏 Ethereum in einen hyperskalierbaren Co-Prozessor zu heben, ist ein Game-Changer. Auf unserer Seite gedeiht die Skalierungsinfrastruktur nur, wenn sie mit transparenten, prüfbaren Daten zur Transaktionsverarbeitung und -priorisierung kombiniert wird. Ohne dies öffnet die niedrige Latenzzeit der Finalität die Tür zur Zentralisierung.

0xprincess24. Sept., 22:26

1// Wir freuen uns, den Start des TOOL Testnets bekannt zu geben!

3,35K

Das Gesetz des Verifiers ist eine großartige Perspektive, Jason. Ich bin neugierig, was du über Bereiche wie Kryptographie oder On-Chain-Daten denkst – wo die Verifizierung fast kostenlos ist, aber die Komplexität der Lösungen explodiert? 💭🔐

Jason Wei16. Juli 2025

New blog post about asymmetry of verification and "verifier's law":

Asymmetry of verification–the idea that some tasks are much easier to verify than to solve–is becoming an important idea as we have RL that finally works generally.

Great examples of asymmetry of verification are things like sudoku puzzles, writing the code for a website like instagram, and BrowseComp problems (takes ~100 websites to find the answer, but easy to verify once you have the answer).

Other tasks have near-symmetry of verification, like summing two 900-digit numbers or some data processing scripts. Yet other tasks are much easier to propose feasible solutions for than to verify them (e.g., fact-checking a long essay or stating a new diet like "only eat bison").

An important thing to understand about asymmetry of verification is that you can improve the asymmetry by doing some work beforehand. For example, if you have the answer key to a math problem or if you have test cases for a Leetcode problem. This greatly increases the set of problems with desirable verification asymmetry.

"Verifier's law" states that the ease of training AI to solve a task is proportional to how verifiable the task is. All tasks that are possible to solve and easy to verify will be solved by AI. The ability to train AI to solve a task is proportional to whether the task has the following properties:

1. Objective truth: everyone agrees what good solutions are

2. Fast to verify: any given solution can be verified in a few seconds

3. Scalable to verify: many solutions can be verified simultaneously

4. Low noise: verification is as tightly correlated to the solution quality as possible

5. Continuous reward: it’s easy to rank the goodness of many solutions for a single problem

One obvious instantiation of verifier's law is the fact that most benchmarks proposed in AI are easy to verify and so far have been solved. Notice that virtually all popular benchmarks in the past ten years fit criteria #1-4; benchmarks that don’t meet criteria #1-4 would struggle to become popular.

Why is verifiability so important? The amount of learning in AI that occurs is maximized when the above criteria are satisfied; you can take a lot of gradient steps where each step has a lot of signal. Speed of iteration is critical—it’s the reason that progress in the digital world has been so much faster than progress in the physical world.

AlphaEvolve from Google is one of the greatest examples of leveraging asymmetry of verification. It focuses on setups that fit all the above criteria, and has led to a number of advancements in mathematics and other fields. Different from what we've been doing in AI for the last two decades, it's a new paradigm in that all problems are optimized in a setting where the train set is equivalent to the test set.

Asymmetry of verification is everywhere and it's exciting to consider a world of jagged intelligence where anything we can measure will be solved.

878

Top

Ranking

Favoriten