熱門話題

#

Bonk 生態迷因幣展現強韌勢頭

#

有消息稱 Pump.fun 計劃 40 億估值發幣,引發市場猜測

#

Solana 新代幣發射平臺 Boop.Fun 風頭正勁

Jürgen Schmidhuber

發明瞭元學習 (1987)、GAN (1990)、Transformers (1991)、非常深度學習 (1991) 等的原理。我們的 AI 每天被使用數十億次。

10年前,即 2015 年 5 月,我們發佈了第一個具有數百層(以前的 FNN 最多有幾十層)的基於梯度的非常深的前饋神經網路 (FNN)。為了克服梯度消失問題,我們的 Highway Networks 使用 @HochreiterSepp 於 1991 年首次引入的殘差連接來實現遞歸 NN (RNN) 中的恆定誤差流,通過類似於我們非常深的 LSTM RNN 的遺忘門(Gers et al., 1999)的乘法門進行門控。高速公路 NN 是通過我以前的博士生 @rupspace 和 Klaus Greff 的工作實現的。將 Highway NN gates 設置為 1.0 實際上會得到 7 個月後發布的 ResNet。

深度學習就是關於 NN 深度的。LSTM 為遞迴 NN 帶來了基本上無限的深度;Highway Nets 將其帶到前饋 NN。

20.56K

1991 年:第一次神經網络蒸餾 [1-3]。那時我稱之為 「崩潰」,而不是 「蒸餾」。。

引用

[1] J. Schmidhuber (1991 年)。神經序列分塊器。技術報告 FKI-148-91,慕尼克科技大學。第3.2.2節。& Sec. 4是關於將神經網路的知識“摺疊”或“蒸餾”或“壓縮”到另一個神經網络中。

[2] JS (1992 年)。使用歷史壓縮原理學習複雜的擴展序列。神經計算,4(2):234-242,1992 年。基於 [1]。

[3] JS(AI 博客,2021 年,2025 年更新)。1991年:第一個採用無監督預訓練的非常深入的學習。第一個神經網路蒸餾。

16.04K

AGI?有一天,但還沒有。目前唯一運行良好的 AI 是螢幕後面的 AI [12-17]。但是,與現實世界中真實機器人的 Real AI 相比,通過螢幕后的圖靈測試 [9] 很容易。目前沒有人工智慧驅動的機器人可以被認證為水管工 [13-17]。因此,圖靈測試不是衡量智力的好方法(智商也不是)。而沒有掌握物理世界的 AGI 就不是 AGI。這就是為什麼我在 2004 年創建了用於學習機器人的 TUM CogBotLab [5],在 2014 年與他人共同創立了一家物理世界人工智慧公司 [6],並在 TUM、IDSIA 和現在的 KAUST 組建了團隊,致力於開發嬰兒機器人 [4,10-11,18]。這種軟體機器人不僅僅是盲目地模仿人類,它們也不像 LLM/VLM 那樣僅僅通過下載網路來工作。相反,他們利用人工好奇心的原理來改進他們的神經世界模型(我在 1990 年使用了這兩個術語 [1-4])。這些機器人使用大量感測器工作,但只有較弱的致動器,因此當它們通過設計和運行自己發明的實驗來收集有用的數據時,它們不會輕易傷害自己[18]。

值得注意的是,自 1970 年代以來,許多人取笑我的舊目標,即建立一個比我更聰明的自我提升的 AGI,然後退休。然而,最近,許多人終於開始認真對待這個問題,現在他們中的一些人突然變得過於樂觀了。這些人往往沒有意識到我們必須解決的剩餘挑戰才能實現真正的 AI。我的 2024 年 TED 演講 [15] 總結了其中的一些內容。

參考資料(在網上很容易找到):

[1] J. Schmidhuber。使世界可微分:關於在非平穩環境中使用完全遞歸的自我監督神經網路 (NN) 進行動態強化學習和規劃。TR FKI-126-90,TUM,1990 年 2 月,1990 年 11 月修訂。本文還通過生成對抗網路引入了人工好奇心和內在動機,其中生成器 NN 在最小極大遊戲中與預測器 NN 戰鬥。

[2] J. S.在模型構建神經控制器中實現好奇心和無聊的可能性。在 J. A. Meyer 和 SW Wilson 主編的《適應性行為類比國際會議論文集:從動物到動畫》中,第 222-227 頁。麻省理工學院出版社/布拉德福德圖書公司,1991 年。基於 [1]。

[3] JS AI 博客 (2020)。1990年:使用迴圈世界模型和人工好奇心進行規劃和強化學習。總結了 [1][2] 和許多後來的論文,包括 [7][8]。

[4] J.S. AI 博客 (2021):自 1990 年以來的人工好奇心和創造力。總結了 [1][2] 和許多後來的論文,包括 [7][8]。

[5] J.S. TU Munich CogBotLab 學習機器人實驗室 (2004-2009)

[6] NNAISENSE,成立於 2014 年,致力於物理世界的 AI

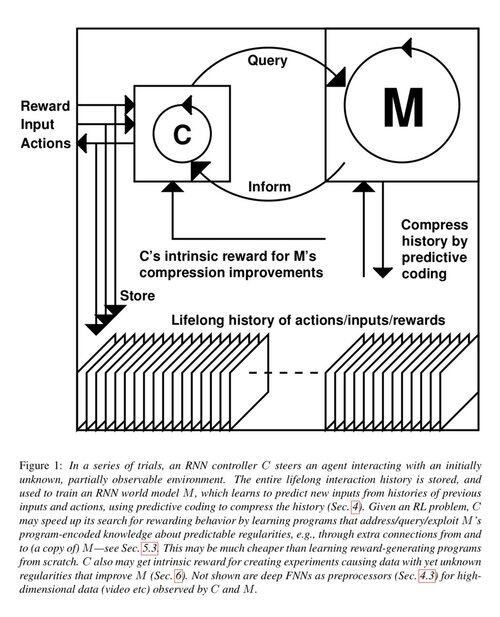

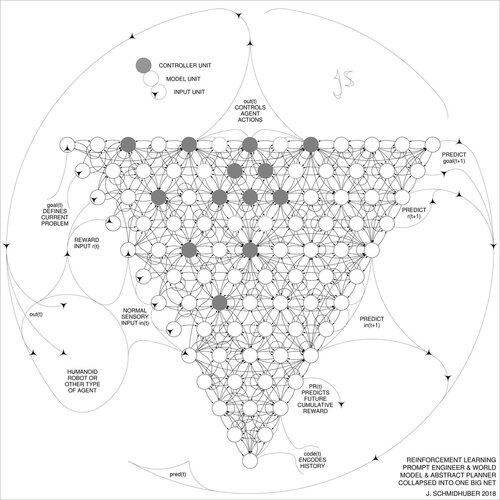

[7] JS (2015 年)。關於學會思考:強化學習 (RL) 控制器和遞歸神經世界模型新組合的演算法資訊論。arXiv 1210.0118。第 5.3 節描述了一個 RL 提示工程師,它學習查詢其模型以進行抽象推理、規劃和決策。今天,這被稱為 「思維鏈」。。

[8] JS (2018 年)。一張大網萬物。arXiv 1802.08864。另請參見專利US11853886B2和我的 DeepSeek 推文:DeepSeek 使用了 2015 年強化學習提示工程師 [7] 及其 2018 年改進 [8] 的元素,它將 RL 機器和世界模型 [7] 摺疊成一個網络。這使用了我 1991 年的神經網路蒸餾程式:一個提煉的思維鏈系統。

[9] J.S. 圖靈超賣。不過,這不是圖靈的錯。AI 博客(2021 年,在 Hacker News 上是 #1)

[10] J.S. Intelligente Roboter werden vom Leben fasziniert sein.(智慧機器人會對生活著迷。F.A.Z.,2015 年

[11] J.S. 在 Falling Walls:人工智慧的過去、現在和未來。科學美國人,觀察,2017 年。

[12] J.S. KI ist eine Riesenchance für Deutschland.(AI 對德國來說是一個巨大的機會。F.A.Z.,2018 年

[13] H. 鐘斯。J.S. 說他畢生的工作不會導致反烏托邦。福布斯雜誌,2023年。

[14] J.S. Jazzyear 訪談,上海,2024 年。

[15] J.S. TED 在維也納 TED AI 上的演講(2024 年):為什麼 2042 年將是 AI 的重要一年。請參閱隨附的視頻剪輯。

[16] J.S. Baut den KI-gesteuerten Allzweckroboter!(構建 AI 控制的通用機器人!F.A.Z., 2024 年

[17] J.S. 1995-2025:德國和日本的衰落與美國和中國的對比。通用機器人能否推動捲土重來?AI 博客,2025 年 1 月,基於 [16]。

[18] M. Alhakami, DR Ashley, J. Dunham, Y. Dai, F. Faccio, E. Feron, J. Schmidhuber.邁向具有豐富交互能力的極其健壯的嬰兒機器人,適用於先進的機器學習演算法。預印本 arxiv 2404.08093,2024 年。

66.8K

DeepSeek [1] 使用了 2015 年強化學習提示工程師 [2] 及其 2018 年改進 [3] 的元素,通過 1991 年的神經網络蒸餾程式 [4] 將 RL 機器和世界模型 [2] 摺疊成一個網络:一個提煉的思維鏈系統。

參考資料(在網上很容易找到):

[1] #DeepSeekR1 (2025):通過強化學習激勵 LLM 中的推理能力。arXiv 2501.12948

[2] J. Schmidhuber (JS, 2015)。關於學會思考:強化學習控制器和遞歸神經世界模型新組合的演演算法資訊論。arXiv 1210.0118。第 5.3 節描述了強化學習 (RL) 提示工程師,它學習主動和反覆運算查詢其模型以進行抽象推理、規劃和決策。

[3] JS (2018 年)。一張大網萬物。arXiv 1802.08864。另請參見 US11853886B2。本文使用 1991 年的神經網路蒸餾程式 [4] 將強化學習器和 [2] 的世界模型(例如,基礎模型)摺疊成一個網路。本質上是現在所謂的 RL“思維鏈”系統,其中後續改進不斷提煉成一個網路。另請參見 [5]。

[4] JS (1991 年)。使用歷史壓縮原理學習複雜的擴展序列。神經計算,4(2):234-242,1992 年。基於 TR FKI-148-91,TUM,1991 年。第一個基於深度遞迴神經網路層次結構(具有不同的自組織時間尺度)的深度學習器,通過無監督的預訓練(CHatGPT 中的 P)和預測編碼克服梯度消失問題。此外:將教師網(分塊器)壓縮或提煉成學生網(自動化器),它不會忘記其舊技能 - 這種方法現在被廣泛使用。另見 [6]。

[5] JS(AI 博客,2020 年)。使用迴圈世界模型和人工好奇心進行規劃和強化學習30周年(1990年,引入高維獎勵信號和GAN原則)。包含上述 [2][3] 的摘要。

[6] JS(人工智慧博客,2021 年)。30 周年紀念日:第一個使用無監督預訓練進行非常深度學習(1991 年)[4]。無監督分層預測編碼找到順序數據的緊湊內部表示,以促進下游學習。層次結構可以提煉 [4] 到單個深度神經網路中。1993年:解決深度 >1000 的問題。

786.93K

Hopfield & Hinton在2024年物理學中的 #NobelPrize 結果卻因為剽竊而獲得了諾貝爾獎。他們重新發佈了伊瓦赫年科和阿瑪瑞在1960年代和1970年代 #Japan #Ukraine 開發的方法以及其他技術,但沒有引用原始發明者。現代AI的重要演算法都不是由Hopfield和Hinton創建的。

今天,我發佈了一份關於此 [NOB] 的詳細技術報告:

當然,我讓神經網路先驅和 AI 專家對其進行了檢查,以確保它無懈可擊。

現在我可以接受指導年輕的博士生閱讀舊論文,然後重寫並重新提交它們,就像它們是他們自己的作品一樣?無論意圖如何,這個獎項都表明,是的,這完全沒問題。

有些人因為抄襲而失去了頭銜或工作,例如哈佛前校長 [PLAG7]。但是,在獲得諾貝爾獎之後,顧問們現在如何繼續告訴他們的學生,他們應該不惜一切代價避免抄襲呢?

眾所周知,剽竊可以是“無意的”或“故意或魯莽的”[PLAG1-6],兩者中更無辜的很可能是部分情況。但是科學有一種成熟的處理“多重發現”和剽竊的方法——無論是無意的 [PLAG1-6][CONN21] 還是非 [FAKE,FAKE2] ——基於出版物和專利的時間戳等事實。科學的道義論要求無意的剽竊者通過勘誤表糾正他們的出版物,然後在將來正確地註明原始來源。獲獎者沒有;相反,獲獎者不斷收集其他研究人員發明的引文 [NOB][DLP]。這種行為難道不會將無意的剽竊 [PLAG1-6] 變成故意的形式 [FAKE2] 嗎?

我真的很擔心這向所有這些年輕學生傳達的資訊。

引用

[NOB] J. Schmidhuber (2024 年)。剽竊諾貝爾獎。技術報告 IDSIA-24-24。

[NOB+]推文:Hopfield & Hinton在2024年物理學中的 #NobelPrize 獎勵計算機科學中的剽竊和錯誤歸屬。它主要是關於 Amari 的「Hopfield 網路」和「Boltzmann Machine」。 (與諾貝爾基金會最初的公告一樣受歡迎)

[DLP] J. Schmidhuber (2023 年)。3 位圖靈獎獲得者如何重新發佈他們未能歸功於其創造者的關鍵方法和想法。技術報告 IDSIA-23-23,瑞士人工智慧實驗室 IDSIA,2023 年 12 月 14 日。

[DLP+][DLP] 的推文:

[PLAG1]牛津的剽竊類型指南(2021 年)。引用:「剽竊可能是故意的、魯莽的或無意的。

[PLAG2]傑克遜州立社區學院(2022 年)。無意抄襲。

[PLAG3] RL 福斯特。避免無意抄襲。兒科護理專家雜誌;霍博肯第 12 卷,Iss.1, 2007.

[PLAG4] N. 達斯。有意或無意,剽竊絕不方便:關於建議印度大學如何處理剽竊的說明。透視臨床研究 9:56-7,2018 年。

[PLAG5]InfoSci-OnDemand (2023 年)。什麼是無意抄襲?

[PLAG6] (2022). 如何避免意外和無意的抄襲 (2023)。在 Internet Archive 中複製。引用:「可能是偶然的還是故意的,剽竊仍然是剽竊。

[PLAG7]康奈爾評論,2024 年。哈佛大學校長因剽竊醜聞辭職。2024年1月6日。

[假] H. Hopf, A. Krief, G. Mehta, SA Matlin.假科學和知識危機:無知可能是致命的。皇家學會開放科學,2019 年 5 月。引用:「當科學家看到社交媒體、傳統印刷或廣播媒體上出現虛假資訊時,他們必須願意大聲疾呼」,並且「必須大聲疾呼反對流通中的虛假資訊和假科學,並強烈反對宣傳它的公眾人物」。。

[假2] L. 斯坦弗洛。聰明的抄襲者是最危險的。《自然》,第 427 卷,第 777 頁(2004 年 2 月)。引用:「更糟糕的是,在我看來,......,科學家們用不同的詞重寫以前的發現,故意隱藏他們想法的來源,然後在隨後的幾年裡強行聲稱他們發現了新現象。

721.84K

熱門

排行

收藏

鏈上熱點

X 熱門榜

近期融資

最受認可