Актуальные темы

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Frank Downing

Да.

Я слышал, что "браузеры — это идеальное средство распространения для агентов". Я думаю, это неправильно.

Агенты будут использовать браузеры как инструмент, среди прочих, для выполнения задач.

Вы будете рассматривать агента как продукт, а не браузер.

Вы платите за ChatGPT Agent, который запускает браузеры для выполнения задач по мере необходимости. Вы можете наблюдать и вмешиваться, но это не обязательно.

Та же тенденция для Comet от Perplexity. Он встречает пользователей там, где они находятся сегодня, но со временем агент будет управлять все больше и больше, и вам будет все меньше и меньше интересно, как это делается.

qw22 июл., 03:12

веб-сайты заменяют большинство настольных приложений (последние 2 десятилетия)

затем агенты заменяют большинство веб-сайтов (следующие 2 десятилетия)

32,72K

Хорошие данные о важности "инженерии контекста":

Входные токены могут быть дешевле выходных токенов, но задачи с большим контекстом (например, программирование) могут требовать в 300-400 раз больше входных токенов контекста, чем выходных токенов, что делает контекст 98% от общих затрат на использование LLM.

Задержка также увеличивается с увеличением размера контекста.

Подчеркивает важность предоставления правильного контекста в нужное время при создании AI-приложений и, как я предполагаю, оставляет много возможностей для конкурентного различия в AI-ориентированных SaaS-приложениях.

Tomasz Tunguz9 июл., 01:36

Когда вы запрашиваете ИИ, он собирает соответствующую информацию, чтобы ответить вам.

Но сколько информации нужно модели?

Беседы с практиками показали их интуицию: входные данные были примерно в 20 раз больше, чем выходные.

Но мои эксперименты с интерфейсом командной строки инструмента Gemini, который выводит подробную статистику токенов, показали, что это гораздо больше.

В среднем 300 раз и до 4000 раз.

Вот почему это высокое соотношение входных и выходных данных имеет значение для всех, кто строит с ИИ:

Управление затратами зависит от входных данных. Поскольку вызовы API оцениваются по токенам, соотношение 300:1 означает, что затраты определяются контекстом, а не ответом. Эта ценовая динамика верна для всех основных моделей.

На странице цен OpenAI выходные токены для GPT-4.1 в 4 раза дороже входных токенов. Но когда входные данные в 300 раз более объемные, затраты на входные данные все равно составляют 98% от общего счета.

Задержка зависит от размера контекста. Важным фактором, определяющим, сколько времени пользователь ждет ответа, является время, необходимое модели для обработки входных данных.

Это переопределяет инженерную задачу. Это наблюдение доказывает, что основной вызов при работе с LLM не только в том, чтобы задавать вопросы. Это инженерия контекста.

Критическая задача заключается в создании эффективного извлечения данных и контекста - разработке конвейеров, которые могут находить лучшую информацию и сжимать ее до минимального возможного объема токенов.

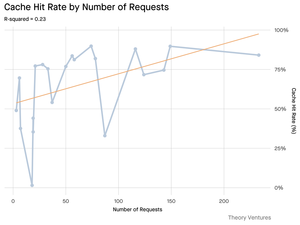

Кэширование становится критически важным. Если 99% токенов находятся во входных данных, создание надежного кэширования для часто запрашиваемых документов или общих контекстов запросов переходит из разряда "желательно иметь" в основное архитектурное требование для создания экономически эффективного и масштабируемого продукта.

Для разработчиков это означает, что сосредоточение на оптимизации входных данных является критическим рычагом для контроля затрат, снижения задержки и, в конечном итоге, создания успешного продукта на базе ИИ.

1,48K

Два усиливающих маховика ускоряют принятие AI IDE (интегрированной среды разработки):

1. Маховик модели-продукта:

По мере улучшения базовых моделей (логика, планирование, использование инструментов) AI IDE, построенные на их основе, мгновенно становятся лучше, что приводит к увеличению использования продукта. Поскольку AI IDE становятся основными потребителями токенов, поставщики базовых моделей получают стимулы оптимизировать эти рабочие процессы — что еще больше увеличивает производительность.

2. Маховик пользовательских данных:

По мере того как AI IDE привлекают больше разработчиков, они генерируют собственные данные использования (что спрашивают разработчики, как они кодируют, где они застревают). Эти данные могут быть использованы для обучения специализированных моделей, настроенных для самой IDE — что приводит к лучшему пользовательскому опыту и производительности, а также к более глубокому барьеру для входа.

#1 приносит пользу категории. #2 приносит пользу лидеру категории.

26,17K

Мне смешно, что Клод лучше отвечает на вопросы о моем Gmail, чем Google Gemini.

Последние версии Gemini показывают отличные результаты в бенчмарках, и я слышал анекдоты о том, что они отлично справляются с кодированием, но реальный опыт использования приложения Gemini никогда не соответствовал моему опыту с ChatGPT, Клодом или Гроком.

224,54K

Мы опубликовали технический документ совместно с Coinbase в январе 2017 года, за 8 месяцев до того, как они привлекли финансирование серии D с оценкой в $1,6 миллиарда. Мы восхищались подходом компании к привлечению новых пользователей в криптоэкономику -> опора на инновации с высокой скоростью разработки продуктов, при этом соблюдая правила. Сегодня стоимость компании составляет ~$65 миллиардов, что представляет собой примерно 60% годовой доходности для инвесторов серии D за последние ~8 лет.

Tesla, Palantir и теперь Coinbase: все компании, которые рынок фундаментально не понимал и наказывал, как будто они были на грани банкротства, теперь признаны лидерами в своих категориях и входят в индекс S&P 500. Хотя мы все еще считаем, что лучшие годы для каждой из этих компаний впереди, доступ к инновациям на ранних этапах, до того как компания попадет в крупные индексы, является ключом к созданию полноценного портфеля.

ARK Invest14 мая 2025 г.

Coinbase is joining the S&P 500. To most, it’s a crypto milestone. To us, it’s a signal. 🧵

264,61K

Топ

Рейтинг

Избранное

В тренде ончейн

В тренде в Х

Самые инвестируемые

Наиболее известные