Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Victor M

🤗 Leiter Produkt-@huggingface

Victor M erneut gepostet

Wir haben gerade 3 Millionen Proben eines hochwertigen Trainingsdatensatzes für Sprach- und Bildmodelle veröffentlicht, die für Anwendungsfälle wie:

📄 optische Zeichenerkennung (OCR)

📊 visuelle Fragenbeantwortung (VQA)

📝 Beschriftung

🤗 Erfahren Sie mehr:

📥 Herunterladen:

80,28K

Victor M erneut gepostet

Sie können jetzt @Alibaba_Qwen Qwen-Image mit dem AI Toolkit mit 24 GB VRAM feinabstimmen, indem Sie einen benutzerdefinierten, trainierten Genauigkeitswiederherstellungsadapter verwenden, der es Ihnen ermöglicht, mit 3 Bit bei minimalem Präzisionsverlust feinabzustimmen. Die markierten Änderungen an den Standardeinstellungen sollten für 3090/4090 GPUs funktionieren. Mehr in 🧵

15,77K

Victor M erneut gepostet

Ich mag @jandotai wirklich sehr

Es ist eine sehr benutzerfreundliche App, um LLMs lokal auszuführen, großartig für die Privatsphäre

Ich habe andere wie LM Studio und Ollama ausprobiert, die sind nett, aber sehr ingenieurlastig, ein bisschen zu schwierig für mich

Jan ist einfach, süß und hübsch und eine großartige Alternative, um zu kommunizieren, ohne deine Daten (und Geheimnisse ;)) an große KI-Anbieter zu senden

Du kannst sogar Modelle von Remote-Anbietern über die API ausführen, wenn du das möchtest!

Außerdem sind sie sehr reaktionsschnell auf Feedback und verbessern die App ständig

Ich denke, es gibt Platz für sowohl lokal ausgeführte LLM-Apps als auch Cloud-LLM-Apps, lokal ausgeführt macht Sinn, wenn du über sehr private Dinge sprechen möchtest, Therapie usw. Es ist wirklich wichtig, dass die Leute das haben können, ohne Angst zu haben, dass ihre Daten in der Zukunft durchsickern könnten

(Ich bin nicht verbunden oder bezahlt, ich mag es einfach wirklich!)

218,33K

Victor M erneut gepostet

Einführung von Jan-v1: 4B-Modell für die Websuche, eine Open-Source-Alternative zu Perplexity Pro.

In unseren Bewertungen liefert Jan v1 eine Genauigkeit von 91 % bei SimpleQA, was Perplexity Pro leicht übertrifft, während es vollständig lokal läuft.

Anwendungsfälle:

- Websuche

- Tiefenforschung

Basierend auf der neuen Version von Qwens Qwen3-4B-Thinking (bis zu 256k Kontextlänge), feinabgestimmt für das Denken und die Nutzung von Werkzeugen in Jan.

Sie können das Modell in Jan, llama.cpp oder vLLM ausführen. Um die Suche in Jan zu aktivieren, gehen Sie zu Einstellungen → Experimentelle Funktionen → Aktivieren, dann Einstellungen → MCP-Server → aktivieren Sie einen suchbezogenen MCP wie Serper.

Verwenden Sie das Modell:

- Jan-v1-4B:

- Jan-v1-4B-GGUF:

Dank an das @Alibaba_Qwen-Team für Qwen3 4B Thinking & @ggerganov für llama.cpp.

633,24K

Qwen-Image + Wan-2.2 = 🔥

Victor M12. Aug., 06:19

Ich bin so begeistert, dass wir jetzt Videos dieser Qualität in weniger als 30 Sekunden generieren können. Open Source für den Sieg!

👇Probier Wan 2.2 (mit Lightning LoRA) auf Hugging Face aus.

1,2K

Victor M erneut gepostet

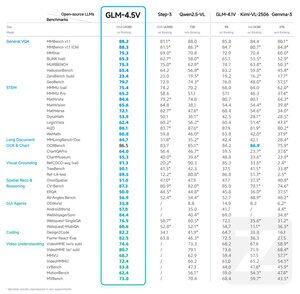

Einführung von GLM-4.5V: ein Durchbruch im Open-Source-Visuellen Denken

GLM-4.5V bietet eine erstklassige Leistung unter den Open-Source-Modellen seiner Größenklasse und dominiert in 41 Benchmarks.

Basierend auf dem GLM-4.5-Air-Basismodell erbt GLM-4.5V bewährte Techniken von GLM-4.1V-Thinking und erreicht effektives Scaling durch eine leistungsstarke 106B-Parameter MoE-Architektur.

Hugging Face:

GitHub:

API:

Jetzt ausprobieren:

264,76K

Top

Ranking

Favoriten

Onchain-Trends

Im Trend auf X

Aktuelle Top-Finanzierungen

Am bemerkenswertesten