Актуальные темы

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Victor M

🤗 Руководитель отдела @huggingface продуктов

Victor M сделал репост

Мы только что выпустили 3 миллиона образцов высококачественного набора данных для обучения языковой модели с визуальным восприятием для таких случаев использования, как:

📄 оптическое распознавание символов (OCR)

📊 визуальный вопрос-ответ (VQA)

📝 создание подписей

🤗 Узнайте больше:

📥 Скачать:

80,27K

Victor M сделал репост

Теперь вы можете донастроить @Alibaba_Qwen Qwen-Image с помощью AI Toolkit с 24 ГБ видеопамяти, используя адаптер для восстановления точности, который позволяет вам настраивать на 3 бита с минимальными потерями точности. Изменения по умолчанию должны работать для GPU 3090/4090. Подробнее в 🧵

15,77K

Victor M сделал репост

Мне действительно очень нравится @jandotai

Это очень дружелюбное приложение для локального запуска LLM, отличное для конфиденциальности

Я пробовал другие, такие как LM Studio и Ollama, и они неплохие, но слишком инженерные, немного слишком сложные для меня

Jan простое, милое и красивое приложение, отличная альтернатива для общения без отправки ваших данных (и секретов ;)) крупным AI-поставщикам

Вы даже можете запускать модели удаленных провайдеров через API, если вам это нужно!

Кроме того, они очень отзывчивы к отзывам и постоянно улучшают приложение

Я думаю, что есть место как для локально запущенных LLM-приложений, так и для облачных LLM-приложений, локальный запуск имеет смысл, если вы хотите говорить о очень личных вещах, терапии и т.д. Очень важно, чтобы люди могли это делать, не опасаясь, что их данные могут утечь в будущем

(Я не связан с этим и не получаю за это деньги, просто мне это действительно нравится!)

218,32K

Victor M сделал репост

Представляем Jan-v1: модель 4B для веб-поиска, открытая альтернатива Perplexity Pro.

В наших оценках Jan v1 демонстрирует 91% точности SimpleQA, немного превосходя Perplexity Pro, при этом полностью работая локально.

Сценарии использования:

- Веб-поиск

- Глубокие исследования

Создан на новой версии Qwen's Qwen3-4B-Thinking (до 256k длины контекста), доработан для рассуждений и использования инструментов в Jan.

Вы можете запустить модель в Jan, llama.cpp или vLLM. Чтобы включить поиск в Jan, перейдите в Настройки → Экспериментальные функции → Включить, затем Настройки → MCP-серверы → включите связанный с поиском MCP, такой как Serper.

Используйте модель:

- Jan-v1-4B:

- Jan-v1-4B-GGUF:

Благодарность команде @Alibaba_Qwen за Qwen3 4B Thinking и @ggerganov за llama.cpp.

633,24K

Qwen-Image + Wan-2.2 = 🔥

Victor M12 авг., 06:19

Я так взволнован, что теперь мы можем генерировать видео такого качества менее чем за 30 секунд. Открытый код — это победа!

👇Попробуйте Wan 2.2 (с Lightning LoRA) на Hugging Face

1,19K

Victor M сделал репост

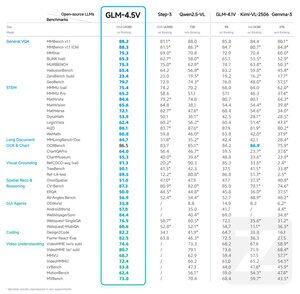

Представляем GLM-4.5V: прорыв в области визуального рассуждения с открытым исходным кодом

GLM-4.5V демонстрирует выдающиеся результаты среди моделей с открытым исходным кодом в своем классе размеров, превосходя 41 эталон.

Созданный на базе модели GLM-4.5-Air, GLM-4.5V наследует проверенные методы от GLM-4.1V-Thinking, достигая эффективного масштабирования благодаря мощной архитектуре MoE с 106 миллиардами параметров.

Hugging Face:

GitHub:

API:

Попробуйте сейчас:

264,76K

Топ

Рейтинг

Избранное

В тренде ончейн

В тренде в Х

Самые инвестируемые

Наиболее известные