Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Was ist ein $CODEC Operator?

Es ist der Punkt, an dem Vision-Language-Action-Modelle KI endlich nützlich für echte Arbeit machen.

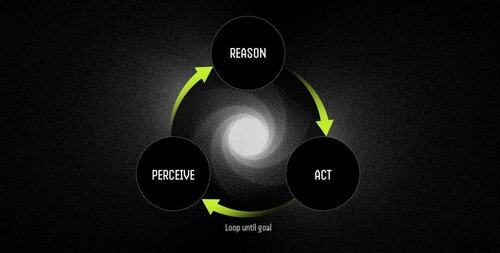

Ein Operator ist ein autonomer Software-Agent, der von VLA-Modellen angetrieben wird und Aufgaben durch einen kontinuierlichen Wahrnehmen-Denken-Handeln-Zyklus ausführt.

LLMs können brillant denken und sprechen, aber sie können nichts zeigen, klicken oder greifen. Sie sind reine Denkmaschinen ohne jegliche Verankerung in der physischen Welt.

VLAs kombinieren visuelle Wahrnehmung, Sprachverständnis und strukturierte Aktionsausgaben in einem einzigen Vorwärtsdurchlauf. Während ein LLM beschreibt, was geschehen sollte, sorgt ein VLA-Modell tatsächlich dafür, dass es geschieht, indem es Koordinaten, Steuersignale und ausführbare Befehle ausgibt.

Der Workflow des Operators ist:

- Wahrnehmung: erfasst Screenshots, Kamerafeeds oder Sensordaten.

- Denken: verarbeitet Beobachtungen zusammen mit Anweisungen in natürlicher Sprache unter Verwendung des VLA-Modells.

- Handlung: führt Entscheidungen durch UI-Interaktionen oder Hardwaresteuerung aus – alles in einem kontinuierlichen Loop.

Beispiele: LLM vs. Operator, der von VLA-Modell angetrieben wird

Ein Meeting planen

LLM: Gibt eine detaillierte Erklärung des Kalender-Managements und der Schritte zur Planung eines Meetings.

Operator mit VLA-Modell:

- Erfasst den Desktop des Benutzers.

- Identifiziert die Kalenderanwendung (z. B. Outlook, Google Kalender).

- Navigiert zu Donnerstag, erstellt ein Meeting um 14 Uhr und fügt Teilnehmer hinzu.

- Passt sich automatisch an Änderungen der Benutzeroberfläche an.

Robotik: Objekte sortieren

LLM: Generiert präzise schriftliche Anweisungen zum Sortieren von Objekten, wie z. B. das Identifizieren und Organisieren roter Komponenten.

Operator mit VLA-Modell:

- Beobachtet den Arbeitsplatz in Echtzeit.

- Identifiziert rote Komponenten unter gemischten Objekten.

- Plant kollisionfreie Trajektorien für einen Roboterarm.

- Führt Pick-and-Place-Operationen aus und passt sich dynamisch an neue Positionen und Orientierungen an.

VLA-Modelle überbrücken endlich die Kluft zwischen KI, die über die Welt nachdenken kann, und KI, die sie tatsächlich verändern kann. Sie verwandeln Automatisierung von fragilen Regelbefolgungen in adaptive Problemlösungen – intelligente Arbeiter.

"Traditionelle Skripte brechen, wenn sich die Umgebung ändert, aber Operatoren nutzen visuelles Verständnis, um sich in Echtzeit anzupassen und Ausnahmen zu behandeln, anstatt bei ihnen abzustürzen."

1,36K

Top

Ranking

Favoriten