Tendencias del momento

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

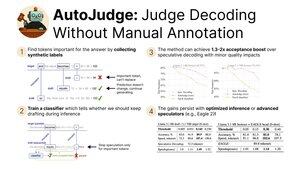

¡Emocionado de compartir nuestra investigación reciente sobre AutoJudge, una técnica de decodificación que combina:

- Aceleración de la inferencia mediante la relajación de la restricción de coincidencia de distribución

- Facilidad de uso y escalabilidad gracias a un protocolo de entrenamiento auto-supervisado

¡Presentando en #NeurIPS2025 hoy! (1/9)

Descubrimos que podemos extraer automáticamente las etiquetas para el clasificador de aceptación. Específicamente, tomamos un conjunto de datos y ejecutamos generaciones de modelos objetivo y borrador.

Luego, verificamos todos los tokens que no coinciden entre los modelos objetivo y borrador. Si mantener el token del modelo borrador resulta en la respuesta incorrecta, se marca como importante (3/9)

Usando estas etiquetas, podemos entrenar un clasificador simple para encontrar tokens importantes en el momento de la inferencia.

Si la decodificación especulativa original rechaza un token, le damos una segunda oportunidad preguntando al clasificador. Para los tokens no importantes, continuamos con la generación, pero para los demás comenzamos un nuevo ciclo especulativo (4/9)

Nuestras principales evaluaciones de AutoJudge se centran en tareas para las cuales es fácil medir la corrección de las respuestas: programación (LiveCodeBench) y matemáticas (GSM8K).

Con pares de modelos como 8B/70B, ¡podemos lograr hasta 40 tokens aceptados por ciclo con una precisión de <1%! (5/9)

AutoJudge también se integra fácilmente con marcos de inferencia de código abierto como vLLM. Las mejoras en la tasa de aceptación se traducen en aceleraciones de extremo a extremo: si sacrificamos un 2% de precisión, ¡obtenemos casi un 50% más de tokens por segundo! (6/9)

Inspeccionar las anotaciones de los tokens importantes revela un patrón curioso: los errores claros se marcan como muestras negativas (=> necesitan ser regeneradas), mientras que los tokens semánticamente equivalentes permiten que la especulación continúe (7/9)

Para saber más, consulta:

Documento:

Código:

Publicación del blog:

Activaciones precomputadas para GSM8K y LiveCodeBench:

(8/9)

Este trabajo fue liderado por mis increíbles coautores @garipovroma, @MightyNeighbour, Ivan Ermakov, Ruslan Svirschevski y Vage Egiazarian.

El equipo está en San Diego para NeurIPS esta semana — ¡ven a saludar hoy en la sesión de pósters!

4:30pm, póster #2010 (9/9)

755

Parte superior

Clasificación

Favoritos