Tópicos populares

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

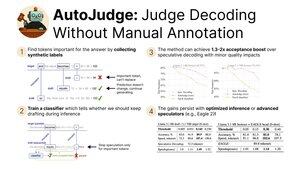

Entusiasmado por compartilhar nossa pesquisa recente sobre o AutoJudge, uma técnica de decodificação que combina:

- Aceleração da inferência através do relaxamento da restrição de correspondência de distribuição

- Facilidade de uso e escalabilidade devido a um protocolo de treinamento auto-supervisionado

Apresentando no #NeurIPS2025 hoje! (1/9)

Descobrimos que podemos minerar automaticamente os rótulos para o classificador de aceitação. Especificamente, pegamos um conjunto de dados e executamos gerações de modelos alvo e rascunho.

Em seguida, verificamos todos os tokens que não coincidem entre os modelos alvo e rascunho. Se manter o token do modelo rascunho resultar na resposta errada, é marcado como importante (3/9)

Usando esses rótulos, podemos treinar um classificador simples para encontrar tokens importantes no momento da inferência.

Se a decodificação especulativa original rejeitar um token, damos a ele uma segunda chance perguntando ao classificador. Para tokens não importantes, continuamos a geração, mas para os outros começamos um novo ciclo especulativo (4/9)

As nossas principais avaliações do AutoJudge concentram-se em tarefas para as quais é fácil medir a correção das respostas — programação (LiveCodeBench) e matemática (GSM8K).

Com pares de modelos como 8B/70B, conseguimos alcançar até 40 tokens aceites por ciclo com uma precisão de <1%! (5/9)

O AutoJudge também se integra facilmente com frameworks de inferência de código aberto, como o vLLM. As melhorias na taxa de aceitação traduzem-se em aumentos de velocidade de ponta a ponta: se trocarmos 2% de precisão, obtemos quase 50% mais tokens por segundo! (6/9)

Inspecionar as anotações para tokens importantes revela um padrão curioso: erros claros são marcados como amostras negativas (=> precisam ser regenerados), enquanto tokens semanticamente equivalentes permitem que a especulação prossiga (7/9)

Para saber mais, confira:

Documento:

Código:

Postagem no blog:

Ativações pré-computadas para GSM8K & LiveCodeBench:

(8/9)

Este trabalho foi liderado pelos meus incríveis coautores @garipovroma, @MightyNeighbour, Ivan Ermakov, Ruslan Svirschevski e Vage Egiazarian.

A equipe está em San Diego para o NeurIPS esta semana — venham dizer olá hoje na sessão de pôsteres!

16:30, pôster #2010 (9/9)

765

Top

Classificação

Favoritos