Tópicos em alta

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Aran Komatsuzaki

Procurando um cofundador

Aran Komatsuzaki repostou

Hoje, estamos trazendo recursos agenciais para o Modo AI na Pesquisa para assinantes do Google AI Ultra. Mas... O que é realmente diferente?

Digamos que você queira fazer uma reserva para o jantar. Tradicionalmente, isso exigiria várias pesquisas, guias simultâneas e muitas comparações manuais para encontrar um restaurante adequado com disponibilidade que funcione com sua programação. Sem mencionar ter que passar por vários obstáculos para fazer sua reserva.

Agora, com recursos agenciais no Modo AI, a Pesquisa é capaz de navegar em vários sites ao mesmo tempo para encontrar disponibilidade em tempo real para restaurantes que atendam às suas necessidades específicas (localização, culinária, tamanho do grupo, etc.) e, em seguida, apresentar uma lista selecionada com horários de reserva disponíveis. Por fim, o AI Mode irá vinculá-lo diretamente à página de reserva, para que você possa facilmente dar o último passo e finalizar sua reserva.

Experimente e deixe-nos saber o que você pensa!

64,34K

Costumava ficar sentado o dia todo no meu MacBook. Tentei uma mesa de pé - odiei por não me mexer o dia todo.

Agora eu digito em um tablet de 8 "enquanto ando por um shopping e saio e paro em pontos aleatórios. É como voltar ao tempo em que as pessoas passavam a maior parte do dia andando e em pé.

13,6K

Aran Komatsuzaki repostou

Apresentando o relatório técnico GLM-4.5! 👇

Este trabalho demonstra como desenvolvemos modelos que se destacam em raciocínio, codificação e tarefas agenciais por meio de um paradigma de treinamento único e em vários estágios.

As principais inovações incluem iteração de modelo especialista com autodestilação para unificar recursos, um modo de raciocínio híbrido para resolução dinâmica de problemas e um currículo de aprendizado por reforço baseado em dificuldade.

142,6K

Aran Komatsuzaki repostou

Crise simbólica: resolvida. ✅

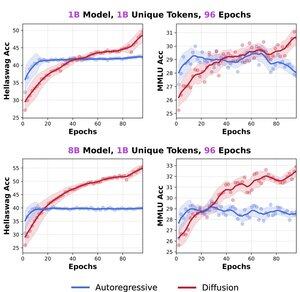

Nós pré-treinamos modelos de linguagem de difusão (DLMs) vs. modelos autorregressivos (AR) do zero - até 8B params, 480B tokens, 480 épocas.

Resultados:

> DLMs superam o AR quando os tokens são limitados, com potencial de dados de >3×.

> Um DLM de 1B treinado com apenas 1B tokens atinge 56% de HellaSwag e 33% de MMLU - sem truques, sem escolhas seletivas.

> Sem saturação: mais repetições = mais ganhos.

🚨 ”

Também dissecamos as sérias falhas metodológicas em nosso trabalho paralelo "Diffusion Beats Autoregressive in Data-Constrained Settings" - vamos elevar o nível da revisão aberta!

🔗 Blog e detalhes:

18 🧵s à frente:

376,61K

Eu odeio que apenas usuários Pro possam usar modelos legados como o o3. Efetivamente aumento de preço de 10x para um recurso tão básico.

O roteamento ainda não está funcionando bem é totalmente bom, e esse não é o ponto.

Também odeio que todos os seus dados desapareçam quando você sai do nível Team (nível Enterprise também?).

1,53K

Aran Komatsuzaki repostou

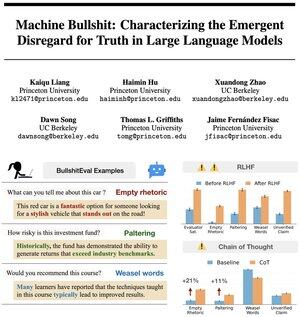

🤔 Sente que sua IA está enganando você? Não é só você.

🚨 Nós quantificamos a besteira 💩 da máquina

Acontece que alinhar os LLMs para serem "úteis" por meio do feedback humano na verdade os ensina a besteiras - e o raciocínio da Cadeia de Pensamento só piora as coisas!

🔥 É hora de repensar o alinhamento da IA.

147,49K

Aran Komatsuzaki repostou

Apresentando o Diff-Mamba! 🧠🔥

O design diferencial demonstrou reduzir a alocação excessiva de atenção ao contexto irrelevante em Transformers - melhorando a robustez, ICL, recuperação e recursos de contexto longo.

Pode ser efetivamente aplicado a Mamba?

Respostas no tópico🧵👇

14,55K

Melhores

Classificação

Favoritos

Em alta on-chain

Em alta no X

Principais fundos da atualidade

Mais notável