Актуальні теми

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Aran Komatsuzaki

Шукаємо співзасновника

Користувач Aran Komatsuzaki поділився

Сьогодні ми впроваджуємо агентські можливості в режим штучного інтелекту в пошуку для підписників Google AI Ultra. Але... Чим насправді відрізняється?

Припустимо, ви хочете забронювати столик на вечерю. Традиційно для цього потрібно кілька пошуків, паралельні вкладки та багато ручних порівнянь, щоб знайти підходящий ресторан із наявністю місць, які відповідають вашому розкладу. Не кажучи вже про те, що вам доведеться перестрибнути через кілька обручів, щоб зрештою зробити бронювання.

Тепер, завдяки агентським можливостям у режимі штучного інтелекту, Пошук може переглядати кілька сайтів одночасно, щоб знайти вільні місця в ресторанах, які відповідають вашим конкретним потребам (розташування, кухня, розмір групи тощо), а потім надавати вам підібраний список із доступними часовими проміжками для бронювання. Нарешті, режим штучного інтелекту зв'яже вас безпосередньо зі сторінкою бронювання, щоб ви могли легко зробити останній крок і завершити своє бронювання.

Спробуйте та поділіться з нами своєю думкою!

64,34K

Раніше сидів цілий день на своєму MacBook. Спробував стіл стоячи — зненавидів його за те, що він не рухався цілий день.

Тепер я вводжу голосовий сигнал на 8-дюймовому планшеті під час прогулянки по торговому центру і на вулиці і зупиняюся у випадкових місцях. Таке відчуття, ніби повертаємося в ті часи, коли люди проводили більшу частину дня, ходячи і стоячи.

13,59K

Користувач Aran Komatsuzaki поділився

Представляємо технічний звіт GLM-4.5! 👇

Ця робота демонструє, як ми розробили моделі, які чудово справляються з міркуваннями, кодуванням та агентними завданнями завдяки унікальній, багатоступеневій парадигмі навчання.

Ключові інновації включають ітерацію експертної моделі з самодистиляцією для уніфікації можливостей, гібридний режим міркувань для динамічного вирішення проблем і навчальну програму навчання з підкріпленням на основі складності.

142,6K

Користувач Aran Komatsuzaki поділився

Криза токенів: вирішена. ✅

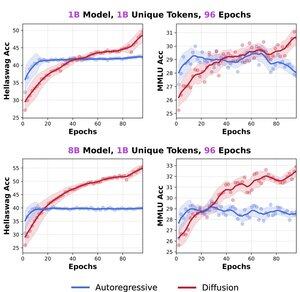

Ми попередньо навчили моделі дифузійної мови (DLM) проти авторегресійних (AR) моделей з нуля — до 8 мільярдів параметрів, 480 мільярдів токенів, 480 епох.

Висновки:

> DLM перевершують AR в умовах обмеженості токенів, з потенціалом даних >3×.

> 1B DLM, натренований лише на 1B токенах, досягає 56% HellaSwag і 33% MMLU — жодних трюків, жодних вишеньок.

> Відсутність насичення: більше повторів = більше виграшів.

🚨 ”

Ми також розібрали серйозні методологічні недоліки в нашій паралельній роботі "Дифузія перемагає авторегресію в налаштуваннях з обмеженнями даних" — давайте піднімемо планку відкритого огляду!

🔗 Блог і подробиці:

Попереду на 18 🧵с:

376,61K

Мені не подобається, що лише користувачі Pro можуть використовувати застарілі моделі, такі як o3. Фактично 10-кратне підвищення ціни за таку базову функцію.

Маршрутизація поки що погано працює – це цілком нормально, і суть не в цьому.

Крім того, я ненавиджу те, що всі ваші дані зникають, коли ви виходите з рівня Team (рівень Enterprise теж?).

1,52K

Користувач Aran Komatsuzaki поділився

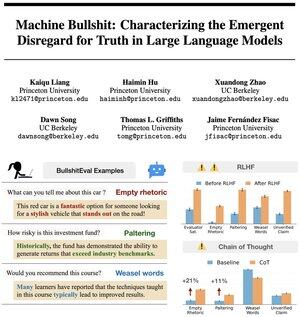

🤔 Відчуваєте, що ваш штучний інтелект вас обманює? Це стосується не лише вас.

🚨 Ми кількісно оцінили машинну 💩 фігню

Виявляється, узгодження LLM так, щоб вони були «корисними» за допомогою людського зворотного зв'язку, насправді вчить їх дурниці, а міркування Chain-of-Thought лише погіршують ситуацію!

🔥 Настав час переосмислити узгодження штучного інтелекту.

147,49K

Користувач Aran Komatsuzaki поділився

Представляємо Diff-Mamba! 🧠🔥

Було показано, що диференціальний дизайн зменшує надмірне виділення уваги на нерелевантний контекст у Transformers, покращуючи надійність, ICL, можливості пошуку та тривалого контексту.

Чи можна ефективно застосувати його до Мамби?

Відповіді в гілці🧵👇

14,55K

Найкращі

Рейтинг

Вибране

Актуальне ончейн

Популярні в X

Нещодавнє найкраще фінансування

Найбільш варте уваги