Trendande ämnen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Elliot Hershberg

Ordet är ute!

@packyM och jag var taggade på att hjälpa till att seeda @Atelfo, @okaymaged och @Convokebio besättningen medan jag var på @notboringco

Författare investerar i författare 🤝🧬

Entusiastisk över denna vision.

Convoke20 aug. 01:04

Vi har samlat in 8,6 miljoner dollar för att bygga ledande AI-verktyg för biopharma-industrin!

Vår såddfinansiering leddes av @kleinerperkins och @_DimensionCap, med deltagande från @ACME, @CommaCapital, @Liquid2V, @notboringco, @AudaciousHQ, @Lux_Capital och ledare inom AI och bioteknik

10,59K

Jag tror att en av de mest lovande aspekterna av AI för läkemedelsupptäckt är fördelen med multimodalitet och förmågan att bygga modeller för många olika uppgifter.

I sin essä från 2012 där han beskrev Erooms lag (läkemedelsupptäcktens exponentiellt minskande FoU-effektivitet) var en av Jack Scannells "diagnoser" för problemet "grundforskning–råstyrka"-bias.

Vi har en tendens att överskatta effekten av att skala upp upptäcktstekniker i ett tidigt skede. Ofta har dessa analyser låg "prediktiv validitet" för klinisk framgång.

Ett sätt som AI-modeller hjälper till att lösa detta problem är att de kan införliva mer translationellt relevanta förutsägelser i de allra tidigaste stadierna av upptäckten.

Jag tror att detta är det geniala i Brandon och Alex vision på Axiom. Genom att minska kostnaden, tiden och friktionen i samband med toxicitetstestning kan den dras mycket tidigare i upptäcktsprocessen – så snart du har en molekyl.

Detta är en av de mest radikala avvikelserna inom molekylär maskininlärning i förhållande till tidiga beräkningskemiska insatser.

Ett stort antal olika identifieringskriterier kan redovisas i en enda framåtpassning.

939

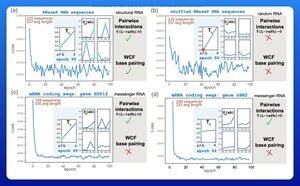

Vad krävs för att en dator ska lära sig reglerna för RNA-basparning?

Människor tränar stora språkmodeller för förutsägelse av RNA-struktur. Vissa av dessa modeller har hundratals miljoner parametrar.

Ett spännande tidigt resultat har varit att dessa modeller lär sig reglerna för Watson-Crick-Franklin basparning direkt från data.

En forskargrupp vid Harvard bestämde sig för att se vilken som var den minsta möjliga modellen som kunde uppnå detta resultat.

De tränade en liten probabilistisk modell med endast 21 parametrar med hjälp av gradient descent.

Med så få som 50 RNA-sekvenser – utan motsvarande strukturer – skulle reglerna för basparning dyka upp efter bara några få träningsepoker.

Så svaret på deras ursprungliga fråga var att det krävs "mycket mindre än du kanske tror" för att lära dig den här typen av modell.

Jag tror inte att det betyder att de storskaliga utbildningsinsatserna nödvändigtvis är dumma eller missriktade. Men det här resultatet tyder på att det finns en hel del effektivitet och prestanda som fortfarande kan utvinnas ur arkitekturinnovation.

Det finns en hel del underliggande struktur i biologins språk.

3,22K

Det är fantastiskt att ha ordet ute för Tahoes serie A.

@nalidoust och @iamjohnnyyu är en fantastisk VD/CSO teknisk grundarduo. @genophoria och @kevansf är båda otroliga vetenskapsmän. Det är ett drömlag.

Ambitionen att ge sig på 1 miljard celler över ett brett spektrum av patientbakgrunder är på gränsen till absurd. Men de bygger infrastrukturen för att göra det till verklighet.

Och den kommersiella visionen är lika intensiv.

Jag kan inte vänta på att mer av Tahoes historia snart ska delas.

Det är ett privilegium att samarbeta med detta team på Amplify.

Nima Alidoust11 aug. 23:25

Vi har samlat in 30 miljoner dollar för att bygga den grundläggande datauppsättningen för virtuella cellmodeller: 1 miljard encellsdatapunkter, som kartlägger 1 miljon läkemedels-patientinteraktioner, som ska delas med en partner.

Vårt mål: Flytta fram gränserna - Från modeller till precisionsläkemedel som hjälper patienter.

🧵 @tahoe_ai

6,16K

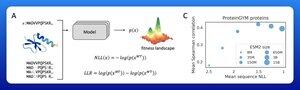

Inom biologin fungerar skalningslagar...

... tills de inte gör det.

För förutsägelse av kondition ökar proteinspråkmodellens prestanda med modellstorleken tills den planar ut och sedan försämras.

När träningsförlusten (NLL) minskar börjar modellerna förutsäga högre sekvenssannolikheter och korrelera mindre med underliggande kondition.

Exempel 10 001 på varför AI för biologi kräver noggrant övervägande av underliggande fördelningar, träningsmål och dussintals andra detaljer.

Skärningspunkten är rik men kräver noggrant arbete inom båda disciplinerna.

12,99K

Trött: Kiselbaserade datorer

Trådbundna (bokstavligen): svampdatorer

Från "Hållbara memristorer från Shiitake Mycelium för högfrekvent bioelektronik"

Idén är att använda adaptiv elektrisk signalering i shiitake (som jag inte visste fanns) som en ersättning för neurala organoider för neuromorfa datorapplikationer.

– Våra resultat visar att svampdatorer kan tillhandahålla skalbara, miljövänliga plattformar för neuromorfa uppgifter och överbrygga bioelektronik

och okonventionell databehandling."

100% en av de mer "okonventionella" forskningsidéerna jag nyligen stött på...

895

Elliot Hershberg delade inlägget

Vi pratade med @ElliotHershberg (Partner @AmplifyPartners) om utmaningarna inom biovetenskapsteknik.

– Det har funnits en allmän känsla av att man kan göra enorma framsteg med nya data och ny teknik inom livsvetenskaperna.

"Det visar sig faktiskt att det är väldigt svårt att hitta ett botemedel mot cancer på en gång."

– Det finns genombrott som Nobelpriset för Alphafold. AI har verklig inverkan på svåra biologiska problem."

"DNA-sekvensering minskar i kostnad snabbare än Moores lag."

"Folk börjar skala modeller, och det blir imponerande snabbt."

7,01K

Tänk om influensavaccin verkligen fungerade?

Och jag menar att det *verkligen* fungerade – till den grad att mänsklighetens endemiska förhållande till influensa blev historia, inte en pågående global hälsoutmaning.

Tänk om vi kunde mildra *alla* snabbt muterande patogener?

Det är därför Jake Glanville grundade Centivax. Hans livsuppgift är att "avsluta det som Edward Jenner påbörjade" genom att utveckla universella vacciner som påskyndar mänsklighetens övergång till en postpatogen framtid.

Jake är precis den typ av teknisk grundare som vi vill samarbeta med på Amplify. Han var en tidig pionjär inom beräkningsbaserad antikroppsdesign på Pfizer, innan han blev en av de första doktoranderna i beräknings- och systembiologi vid Stanford tillsammans med Mark Davis.

Han har syntetiserat ett helt livs arbete till en distinkt – och något motsägelsefull – idé för att utveckla universella vacciner.

Och teamet han har satt ihop är lika extraordinärt. Till exempel är Centivax CMO, Jerry Sadoff, en av de mest produktiva vaccinutvecklarna i livet.

Det är verkligen ett privilegium för oss att delta i serie A-syndikatet för Centivax. Under det senaste decenniet har Jake och hans team sammanställt ett omfattande prekliniskt datapaket för sitt ledande influensaprogram.

Det enda återstående experimentet är att se om detta översätts till människor, vilket är vad den här omgången garanterar.

Om denna teknik är framgångsrik kommer effekten att bli enorm. Och historien om det här lagets uthållighet kommer att kräva en egen bok i bioteknikkanon.

6,71K

Topp

Rankning

Favoriter

Trendande på kedjan

Trendande på X

Senaste toppfinansieringarna

Mest anmärkningsvärda