Topik trending

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

RT untuk membantu Simon meningkatkan kesadaran akan serangan injeksi cepat di LLM.

Terasa sedikit seperti barat liar komputasi awal, dengan virus komputer (sekarang = perintah berbahaya yang bersembunyi di data/alat web), dan pertahanan yang tidak dikembangkan dengan baik (antivirus, atau paradigma keamanan kernel/ruang pengguna yang jauh lebih berkembang di mana misalnya agen diberi jenis tindakan yang sangat spesifik alih-alih kemampuan untuk menjalankan skrip bash sewenang-wenang).

Bertentangan karena saya ingin menjadi pengadopsi awal agen LLM dalam komputasi pribadi saya tetapi kemungkinan barat liar menghalangi saya.

16 Jun 2025

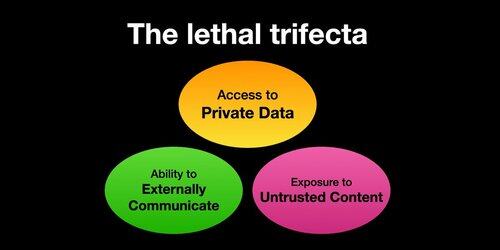

Jika Anda menggunakan "agen AI" (LLM yang memanggil alat), Anda perlu mengetahui Trifecta Mematikan

Setiap kali Anda menggabungkan akses ke data pribadi dengan paparan konten yang tidak tepercaya dan kemampuan untuk mengomunikasikan penyerang secara eksternal dapat mengelabui sistem untuk mencuri data Anda!

Saya harus mengklarifikasi bahwa risikonya tertinggi jika Anda menjalankan agen LLM lokal (misalnya Cursor, Claude Code, dll.).

Jika Anda hanya berbicara dengan LLM di situs web (misalnya ChatGPT), risikonya jauh lebih rendah *kecuali* Anda mulai mengaktifkan Konektor. Misalnya saya baru saja melihat ChatGPT menambahkan dukungan MCP. Ini akan dikombinasikan dengan sangat buruk dengan semua fitur memori yang baru ditambahkan - misalnya bayangkan ChatGPT menceritakan semua yang diketahuinya tentang Anda kepada beberapa penyerang di internet hanya karena Anda mencentang kotak yang salah di pengaturan Konektor.

386,01K

Teratas

Peringkat

Favorit